SoundHound OASYS, 음성 AI를 운영 계층으로 바꾸다

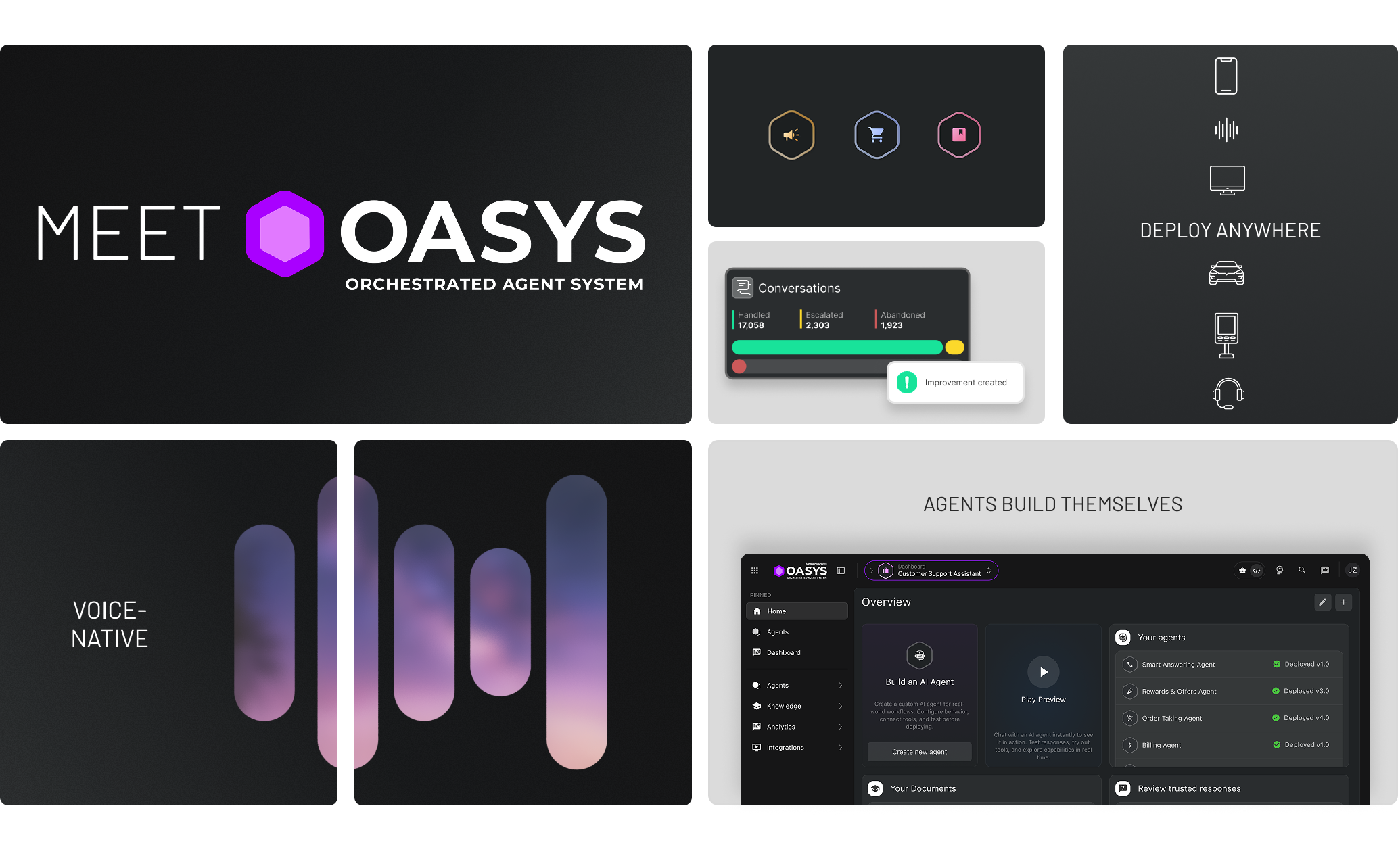

SoundHound OASYS는 음성 에이전트를 전화, 차량, 키오스크, 매장 운영까지 연결하는 self-learning 운영 계층으로 제시합니다.

- 무슨 일: SoundHound AI가 2026년 5월 5일

OASYS를 공개했습니다.- 공식 설명은 문서·transcript·프로세스 자료를 넣으면 AI agent 집합을 만들고, 운영 중 개선안을 제안하는 self-learning platform입니다.

- 핵심 전환: 경쟁축이 좋은 음성 인식에서

agent lifecycle, 현장 채널, 거래 처리, human-in-the-loop 운영으로 이동합니다. - 개발자 포인트: 음성 에이전트는 이제 STT·LLM·TTS 파이프라인이 아니라 test, guardrail, context, escalation을 포함한 운영 시스템입니다.

- 주의점: 발표는 강하지만 실제 평가는 고객 채택, margin, OpenAI·Google 같은 범용 voice model과의 차별화에서 갈립니다.

SoundHound AI가 2026년 5월 5일 공개한 OASYS는 겉으로 보면 또 하나의 기업용 AI 에이전트 플랫폼입니다. 이름도 큽니다. Orchestrated Agent System. 공식 발표는 "AI가 AI를 만들고, 관리하고, 스스로 개선한다"는 메시지를 전면에 놓습니다. 최근 몇 달 동안 거의 모든 엔터프라이즈 소프트웨어 회사가 agent, orchestration, control plane을 말하고 있으니, 이 표현만으로는 새로워 보이지 않을 수도 있습니다.

하지만 OASYS가 흥미로운 이유는 출발점이 다릅니다. 많은 에이전트 플랫폼은 브라우저, 문서, 코드, CRM, Slack 같은 디지털 업무 공간에서 시작합니다. SoundHound의 무대는 전화, drive-thru, 차량 인포테인먼트, 매장 키오스크, 호텔 프런트, 콜센터, IT service desk입니다. 사람이 키보드로 프롬프트를 넣는 곳이 아니라, 고객이 말하고 기다리고 결제하고 항의하고 예약을 바꾸는 곳입니다. 즉 이 발표는 "음성 모델이 좋아졌다"는 뉴스라기보다, 음성 AI 회사가 에이전트 운영 계층을 차지하려는 선언에 가깝습니다.

이 차이는 개발자에게도 중요합니다. 음성 에이전트를 단순히 speech-to-text -> LLM -> text-to-speech 파이프라인으로 만들 수 있던 시기는 빠르게 지나가고 있습니다. 실제 고객 접점에서는 사용자가 중간에 끼어들고, 언어를 바꾸고, 소음 속에서 말하고, 결제나 의료·보험·예약 같은 민감한 행동을 요구합니다. 모델이 한 번 그럴듯하게 답하는 것보다, 어떤 발화를 어떻게 이해했고, 어떤 tool call을 했고, 언제 사람에게 넘겼고, 실패를 어떻게 회복했는지가 더 중요합니다. OASYS가 노리는 지점이 바로 이 운영 문제입니다.

무엇이 발표됐나

SoundHound의 공식 발표에 따르면 OASYS는 기업이 conversational AI agent를 몇 분 안에 만들고, 여러 디지털·물리 채널에 배포하며, 운영 중 성능을 개선하게 하는 플랫폼입니다. 발표문은 OASYS가 documentation, transcript, integration 정보를 ingest하고, agent set과 transaction flow를 생성하며, 생성된 로직을 개발자가 단계별로 볼 수 있게 시각화한다고 설명합니다.

여기서 중요한 표현은 "build"보다 "lifecycle"입니다. SoundHound는 대부분의 agentic AI platform이 개발자의 agent 제작을 돕는 데 머무르지만, OASYS는 create, orchestrate, evaluate, improve까지 관리한다고 주장합니다. live 이후에는 interaction을 분석해 성능 gap과 개선 지점을 찾고, 업데이트를 autonomously engineer한 뒤 human expert에게 제안한다는 구조입니다. 완전 무감독 자기수정이라기보다는, 운영 데이터를 바탕으로 개선안을 만들고 사람이 통제권을 갖는 형태에 가깝습니다.

채널도 넓게 잡았습니다. phone, text, web chat, in-store kiosk, social media, TV, in-vehicle infotainment가 모두 언급됩니다. 공식 제품 글은 이를 "build once, deploy anywhere"로 포장합니다. 이 말이 현실에서 어렵다는 점을 감안하면, SoundHound가 팔고 싶은 것은 모델 API가 아니라 channel abstraction입니다. 고객이 전화로 시작한 대화를 스마트폰이나 차량 화면에서 이어가고, 매장 직원의 earpiece로 sales assist가 들어오며, drive-thru 주문이 POS와 결제 시스템으로 연결되는 구조입니다.

공식 제품 글에는 다음과 같은 사용 사례가 나옵니다. billing dispute를 해결한 뒤 upgrade offer를 제안하는 customer service agent, 운전자가 음성으로 평소 커피 주문을 확인하면 도착 전 결제를 끝내는 in-car commerce, 매장 대화를 듣고 직원에게 bundle 추천을 띄우는 retail floor assist, churn signal을 보고 outbound retention call을 시작하는 agent, EHR을 확인해 처방전 refill을 처리하는 healthcare agent, 직원 access request를 처리하는 IT service desk agent입니다.

이 예시들은 모두 "대답"보다 "처리"에 가깝습니다. 음성 AI가 FAQ를 읽어 주는 단계에서, 업무 상태를 바꾸고 거래를 만드는 단계로 이동한다는 뜻입니다. 성공하면 상담원 비용을 줄이는 수준을 넘어 매출을 만들 수 있습니다. 실패하면 잘못된 결제, 잘못된 의료·보험 처리, 고객 이탈, 규제 리스크로 이어집니다. 그래서 OASYS 발표에서 guardrail, deterministic flow, human touchpoint, escalation이 반복됩니다.

음성 AI의 경쟁축이 바뀌고 있다

최근 음성 AI 뉴스는 대부분 모델 품질에 집중됐습니다. 더 자연스러운 목소리, 더 낮은 지연 시간, 더 정확한 전사, 더 나은 실시간 번역이 headline을 차지했습니다. OpenAI의 Realtime 계열 모델도 그런 흐름 안에 있습니다. 하지만 프로덕션에서 음성 에이전트를 운영하는 팀은 곧 다른 문제에 부딪힙니다. 목소리가 자연스러워도 실제 업무를 끝내지 못하면 고객은 다시 상담원을 찾습니다. 전사가 정확해도 policy boundary가 약하면 기업은 배포를 멈춥니다. 대화가 부드러워도 transaction system과 연결되지 않으면 매출은 생기지 않습니다.

OASYS는 이 병목을 "운영 계층"으로 해석합니다. SoundHound의 공식 제품 글은 function-specific AI deployment가 막히는 이유로 noisy environment에서 무너지는 voice, sensitive task를 안정적으로 처리하지 못하는 agent, 제한된 channel, transaction과 exception 처리 실패, 긴 build cycle을 들었습니다. 이 목록은 모델 벤치마크가 아니라 운영 체크리스트입니다.

개발자 관점에서 이 전환은 아키텍처를 바꿉니다. 과거의 음성 봇은 intent classification과 scripted dialog tree가 중심이었습니다. 사용자가 "예약 변경"이라고 말하면 정해진 slot을 채우고, 예외가 나오면 상담원에게 넘깁니다. LLM 기반 음성 에이전트는 훨씬 유연하지만, 유연성 자체가 위험입니다. 모델이 임의로 말을 만들거나, 권한 없는 action을 실행하거나, 확신 없이 결제·의료·계정 작업을 처리하면 안 됩니다.

따라서 프로덕션 음성 에이전트에는 최소한 네 계층이 필요합니다. 첫째, real-time audio layer입니다. interruption, background noise, multilingual switch, partial transcript를 처리해야 합니다. 둘째, tool orchestration layer입니다. CRM, POS, EHR, payment, identity, ticketing system을 안전하게 호출해야 합니다. 셋째, policy and guardrail layer입니다. 어떤 action이 deterministic flow를 따라야 하는지, 어떤 순간에 human approval이 필요한지 정해야 합니다. 넷째, evaluation and observability layer입니다. 모든 interaction을 agent level로 평가하고, 실패 원인을 추적하고, 개선안을 검토해야 합니다.

OASYS가 말하는 Agentic+ orchestration framework는 이 중 둘째와 셋째 계층을 겨냥합니다. 공식 발표는 autonomous reasoning을 rule-based guardrail과 human touchpoint로 묶고, SoundHound의 Human Augmented Resolution을 통해 AI가 막힌 경우 사람이 뒤에서 개입해 대화를 끊지 않고 해결할 수 있다고 설명합니다. 이것은 완전 자율 에이전트보다 현실적인 포지션입니다. 현장 업무는 100% 자동화를 바로 받아들이기 어렵고, 상담원 escalation은 비용과 고객 경험을 모두 흔듭니다. 중간 형태의 background human assist는 enterprise deployment에서 설득력이 있습니다.

"AI가 AI를 만든다"는 주장의 실제 의미

OASYS 발표에서 가장 강한 문구는 "AI builds AI"입니다. 이 표현은 조심해서 읽어야 합니다. 기업용 agent platform에서 완전히 새로운 agent를 무감독으로 만들고 배포하는 것은 아직 위험합니다. 오히려 공식 설명을 뜯어보면 더 현실적인 패턴이 보입니다. 기존 문서, 대화 transcript, training material, process documentation을 넣으면 platform이 candidate workflow와 agent configuration을 생성합니다. 이후 팀이 이를 검토하고, 테스트하고, live 이후 개선안을 받습니다.

이 구조는 "프롬프트로 봇 만들기"보다 한 단계 진지합니다. 고객지원이나 매장 운영에는 이미 수년치 통화 녹취, 상담원 매뉴얼, FAQ, escalation policy, CRM disposition code, POS 예외 처리 문서가 있습니다. 문제는 이 지식이 AI agent가 곧바로 사용할 수 있는 tool schema와 workflow로 정리돼 있지 않다는 점입니다. OASYS가 이 자료를 ingest해 transaction flow를 만들고, 개발자가 logic을 확인할 수 있게 시각화한다면, build cycle을 줄이는 데 실제 가치가 있습니다.

다만 이 방식이 성공하려면 생성된 agent가 왜 그렇게 행동하는지 설명 가능해야 합니다. "AI가 만들었으니 믿어라"는 enterprise buyer에게 통하지 않습니다. 어떤 문서에서 어떤 rule이 나왔고, 어떤 slot이 필수이며, 어떤 tool call 전에 어떤 confirmation이 필요한지 보여줘야 합니다. SoundHound가 transaction flow visualization을 강조하는 이유도 여기에 있습니다. 에이전트 생성이 자동화될수록, 검토 가능한 중간 산출물이 더 중요해집니다.

운영 중 self-learning도 마찬가지입니다. "스스로 개선한다"는 말은 매력적이지만, 고객 접점에서는 위험한 말이기도 합니다. live traffic에서 agent가 무작정 policy를 바꾸면 안 됩니다. 더 그럴듯한 해석은 매일 interaction을 분석해 실패 패턴, customer drop-off, containment failure, escalation reason, conversion gap을 찾고, 개선안을 사람이 승인하는 것입니다. 이것은 기존 contact center analytics와 MLOps, prompt optimization, agent evaluation이 합쳐진 형태입니다.

이 지점에서 OASYS는 최근 Honeycomb Agent Observability나 LangSmith류 도구와도 맞닿습니다. 차이는 범용 developer observability가 아니라, 음성·고객 접점·거래 흐름에 맞춘 운영 분석이라는 점입니다. 음성 에이전트의 실패는 단순히 trace 하나가 빨갛게 뜨는 문제가 아닙니다. 고객이 말을 반복했는지, 중간에 끊었는지, 상담원에게 넘어갔는지, 결제를 포기했는지, 이후 재문의가 있었는지까지 연결해야 합니다.

SoundHound의 강점과 약점

SoundHound가 이 시장에서 갖는 강점은 명확합니다. 회사는 오래전부터 음성 인식과 voice AI를 해왔고, 자동차, restaurant, contact center, smart device 같은 현장형 channel에 배포 경험이 있습니다. 공식 발표는 400개 이상 특허와 수십억 interactions 처리 경험을 언급합니다. 제품 글은 Hyundai, Chipotle, GoDaddy 같은 브랜드 배포 사례를 배경으로 듭니다. 이것은 foundation model provider가 단기간에 복제하기 어려운 운영 지식입니다.

또 하나의 강점은 물리 채널입니다. 많은 AI agent platform은 웹 브라우저와 SaaS workflow 안에서 편합니다. 하지만 drive-thru, 차량, 매장, 전화망, 키오스크는 다릅니다. 소음, latency, hardware, payment terminal, POS integration, local compliance, 직원 training, 고객 불만 처리까지 엮입니다. OASYS가 "digital and physical spaces"를 반복하는 것은 이 차이를 알고 있다는 신호입니다.

하지만 약점도 큽니다. 첫째, 범용 음성 모델의 발전 속도가 빠릅니다. OpenAI, Google, Anthropic, xAI가 real-time voice, tool use, multimodal context를 계속 개선하면, SoundHound의 모델 자체 차별화는 줄어들 수 있습니다. Reddit의 r/Soundhound 토론에서도 OpenAI의 새 voice model이 SoundHound의 해자를 좁히는지에 대한 우려가 나왔습니다. SoundHound가 이 경쟁에서 살아남으려면 "우리 모델이 더 잘 듣는다"만으로는 부족하고, integration, compliance, workflow ownership, customer outcome에서 차이를 보여줘야 합니다.

둘째, 플랫폼 비전은 영업 실행을 요구합니다. OASYS가 아무리 훌륭해도, enterprise buyer는 실제 고객 채택과 ROI를 봅니다. Simply Wall St는 OASYS 출시와 강한 매출 성장에도 시장 반응이 조심스러웠다고 정리했습니다. Zacks는 2026년 5월 7일 Q1 실적 발표 이후 SoundHound 주가가 16.4% 하락했다고 보도하며, margin pressure와 지속 손실이 부담으로 작용했다고 설명했습니다. 투자자 관점에서는 "큰 비전"보다 고객 전환, gross margin, deployment cost, renewal, expansion이 더 중요합니다.

셋째, horizontal platform과 vertical specialist 사이에서 위치를 잡아야 합니다. ServiceNow, Salesforce, Microsoft, UiPath는 이미 enterprise workflow의 중심을 갖고 있습니다. 이들은 음성 자체는 약할 수 있지만 고객 데이터와 업무 프로세스, approval, identity, audit trail을 쥐고 있습니다. 반대로 PolyAI, Sierra, Kore.ai, Cognigy 같은 CX agent 회사들은 고객 서비스 자동화에 특화돼 있습니다. SoundHound는 voice-native edge와 channel depth를 무기로 삼되, broader operational AI platform이 되려면 더 많은 system integration을 증명해야 합니다.

개발팀이 배워야 할 것은 무엇인가

OASYS를 그대로 도입할지 여부와 별개로, 이 발표는 음성 에이전트를 만드는 팀에게 기준선을 제시합니다. 첫째, 음성은 프론트엔드 기능이 아닙니다. 사용자가 말하는 순간부터 identity verification, context lookup, tool selection, confirmation, transaction execution, logging, escalation이 이어지는 end-to-end workflow입니다. 그래서 voice UI 팀, backend 팀, security 팀, customer operations 팀이 따로 움직이면 실패하기 쉽습니다.

둘째, 에이전트는 channel-neutral하게 설계돼야 합니다. 같은 customer intent가 전화, 웹챗, 차량, kiosk, mobile app에서 들어올 수 있습니다. 각 channel의 UX는 다르지만, order status 조회, appointment change, refund request, prescription refill 같은 core action은 공통입니다. 좋은 설계는 channel adapter와 business workflow를 분리합니다. 음성 channel이 실패해도 웹 링크로 확인을 넘기고, kiosk에서 시작한 interaction을 상담원 화면으로 이어갈 수 있어야 합니다.

셋째, human-in-the-loop는 실패의 표시가 아니라 운영 설계입니다. 많은 AI 제품은 사람 개입을 마치 성능 부족처럼 숨기려 합니다. 하지만 high-stakes customer workflow에서는 사람이 언제, 어떤 권한으로, 어떤 맥락을 보고 개입할 수 있는지가 제품 신뢰성을 결정합니다. OASYS가 Human Augmented Resolution을 강조하는 이유도 여기에 있습니다. 완전 자동화보다 중요한 것은 고객이 대화를 반복하지 않고 해결에 도달하는 것입니다.

넷째, self-improvement는 반드시 governance와 묶여야 합니다. agent가 interaction을 분석해 개선안을 만드는 것은 좋습니다. 그러나 그 개선안이 어떤 metric을 높이고 어떤 risk를 키우는지 봐야 합니다. containment rate를 높이기 위해 부적절한 upsell을 늘리거나, 평균 처리 시간을 줄이기 위해 복잡한 고객을 너무 빨리 상담원에게 넘기면 안 됩니다. 평가 metric은 cost, resolution, customer satisfaction, compliance, revenue, fairness를 함께 봐야 합니다.

다섯째, 음성 에이전트의 observability는 텍스트 agent보다 어렵습니다. transcript만 저장하면 부족합니다. 원본 audio 품질, ASR confidence, interruption timing, language switch, barge-in, silence duration, tool latency, human assist timing, customer sentiment, final outcome까지 연결해야 합니다. 어떤 통화가 실패했는지보다 왜 실패했는지 알아야 다음 agent version을 고칠 수 있습니다.

에이전트 운영체제라는 말의 현실적 의미

요즘 많은 회사가 자신들의 agent platform을 operating system이라고 부릅니다. Fiserv는 banking agentOS를 말했고, 여러 기업은 agent control plane을 말합니다. SoundHound OASYS도 비슷한 언어를 씁니다. 이 표현을 과장으로만 볼 필요는 없습니다. 운영체제라는 말이 정확하려면 세 가지 조건이 필요합니다. 자원을 추상화하고, 실행을 조율하고, 실패와 권한을 관리해야 합니다.

OASYS가 추상화하려는 자원은 voice channel과 customer operation입니다. 전화망, kiosk, vehicle, chat, POS, CRM, EHR, payment, staff assist를 하나의 agent runtime에서 다루겠다는 뜻입니다. 실행 조율은 여러 agent를 한 interaction 안에서 dynamic하게 선택하고 coordination하는 방식으로 설명됩니다. 실패와 권한 관리는 rule-based guardrail, human touchpoint, escalation, QA/testing으로 표현됩니다.

물론 아직 이것이 실제로 얼마나 잘 작동하는지는 고객 사례와 운영 지표를 봐야 합니다. 공식 발표에는 강한 표현이 많지만, 구체적인 customer deployment metric은 제한적입니다. OASYS가 단순 launch announcement에 머물지 않으려면, 앞으로 industry별 containment rate, resolution rate, human assist ratio, transaction completion, deployment cycle reduction 같은 숫자가 나와야 합니다. 특히 "AI가 AI를 만든다"는 주장은 데모보다 운영 데이터로 검증돼야 합니다.

그럼에도 방향성은 분명합니다. 음성 AI 시장은 더 이상 목소리 품질만으로 설명되지 않습니다. 실시간 모델 API는 빠르게 commoditize될 가능성이 있습니다. 그 위에서 누가 고객 시스템에 깊게 붙고, 누가 안전한 workflow를 만들고, 누가 실패를 관찰해 개선하며, 누가 물리 세계의 channel까지 통합하느냐가 경쟁의 중심이 됩니다.

OASYS는 그 전환을 아주 노골적으로 보여주는 발표입니다. SoundHound는 "좋은 음성 AI 회사"가 아니라 "현장 업무와 고객 거래를 처리하는 에이전트 운영 계층"이 되고 싶어 합니다. 이 야심이 성공할지는 아직 모릅니다. 하지만 개발자와 AI 제품팀이 지금 봐야 할 질문은 선명합니다. 당신의 음성 에이전트는 말을 잘합니까, 아니면 실제 운영을 끝까지 책임질 수 있습니까. 2026년의 음성 AI 경쟁은 이 질문에서 갈릴 가능성이 큽니다.