Hermes Agent, 로컬 PC가 스스로 배우는 에이전트가 되다

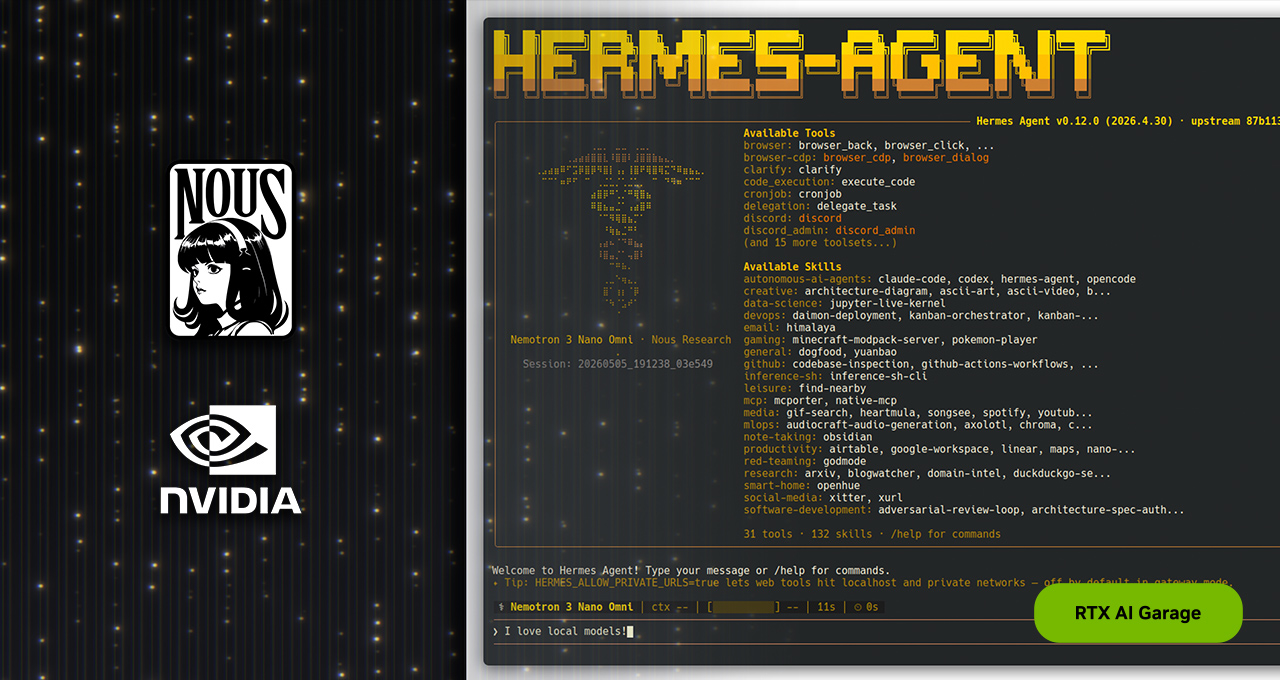

NVIDIA가 Hermes Agent를 RTX와 DGX Spark에 최적화하며 로컬 상시 실행 self-improving agent 경쟁을 밀고 있습니다.

- 무슨 일: NVIDIA가 Nous Research의

Hermes Agent를 RTX PC와 DGX Spark에서 상시 실행하는 로컬 에이전트 사례로 소개했습니다.- Hermes는 경험에서 스킬을 만들고, 메모리를 남기고, 메시징 게이트웨이와 cron으로 계속 접근 가능한 에이전트를 지향합니다.

- 의미: 에이전트 경쟁이 클라우드 모델 호출에서 로컬 런타임과 장기 기억으로 넓어지고 있습니다.

- 주의점: self-improving은 모델 가중치 학습과 다릅니다. 스킬·메모리 개선이 실제 성능 향상인지 평가해야 합니다.

- 반복 작업 오류 감소, 회귀 방지, deterministic checker 같은 검증 장치가 없으면 개선이 아니라 누적된 프롬프트 오염일 수 있습니다.

NVIDIA가 2026년 5월 13일 Nous Research의 오픈소스 에이전트인 Hermes Agent를 RTX PC, RTX PRO 워크스테이션, DGX Spark에서 실행하는 사례로 전면에 올렸습니다. 발표 제목만 보면 하드웨어 회사가 인기 오픈소스 프로젝트를 자사 GPU에 맞춰 소개한 전형적인 생태계 뉴스처럼 보입니다. 하지만 이번 발표는 최근 AI 에이전트 경쟁이 어디로 넓어지는지를 꽤 잘 보여줍니다.

2025년과 2026년의 에이전트 경쟁은 주로 클라우드에서 벌어졌습니다. Codex, Claude Code, GitHub Copilot coding agent, xAI Grok Build, Coder Agents, UiPath for Coding Agents 같은 흐름은 모두 에이전트를 어디에서 실행하고, 어떤 권한으로 코드와 업무 시스템을 만지게 할지에 집중했습니다. 그러나 Hermes와 NVIDIA의 조합은 다른 질문을 던집니다. 에이전트가 매번 클라우드 세션으로 잠깐 켜졌다 꺼지는 존재가 아니라, 사용자의 장비나 사무실 한쪽에서 계속 살아 있는 로컬 런타임이 된다면 무엇이 달라질까요.

Hermes Agent의 공식 설명은 매우 직접적입니다. Nous Research는 Hermes를 "built-in learning loop"를 가진 self-improving AI agent라고 소개합니다. 에이전트가 경험에서 스킬을 만들고, 사용 중 그 스킬을 개선하며, 과거 대화를 검색하고, 세션을 넘나드는 사용자 모델을 축적한다는 주장입니다. NVIDIA는 이 지점을 RTX PC와 DGX Spark의 사용처로 연결합니다. 즉, 로컬 모델과 에이전트 런타임을 모두 내 장비에서 돌리면 대화와 파일이 밖으로 나가지 않고, API 사용량에 따라 비용이 계속 늘지 않으며, Telegram이나 Discord 같은 메시징 채널을 통해 하루 종일 접근할 수 있다는 그림입니다.

중요한 것은 Hermes가 단순한 챗봇 UI로 포지셔닝되지 않는다는 점입니다. NVIDIA 블로그는 Hermes의 차별점으로 self-evolving skills, contained sub-agents, curated skills/tools/plugins, 그리고 같은 모델을 쓰더라도 더 나은 결과를 내는 orchestration layer를 들었습니다. 여기서 "같은 모델"이라는 표현이 흥미롭습니다. 에이전트 품질이 더 이상 모델 점수만으로 설명되지 않는다는 뜻입니다. 어떤 도구를 어떤 순서로 부르고, 실패한 작업을 어떻게 기억하고, 다음번에 재사용 가능한 절차로 바꾸며, 작은 하위 에이전트를 언제 분리하는지가 제품 경쟁력이 됩니다.

| 구분 | 클라우드 에이전트 | 로컬 self-improving agent |

|---|---|---|

| 실행 위치 | 벤더 클라우드, 원격 샌드박스, 호스팅 워크스페이스 | RTX PC, 워크스테이션, DGX Spark, 개인 서버 |

| 개선 방식 | 벤더가 모델과 제품 루프를 업데이트 | 사용자 환경에서 메모리, 스킬, 도구 설정을 축적 |

| 장점 | 강한 모델, 관리형 인프라, 빠른 기능 배포 | 데이터 통제, 상시 실행, 낮은 한계 비용, 개인화 |

| 리스크 | 벤더 종속, 데이터 이동, 사용량 비용 | 평가 부재, 로컬 운영 부담, 스킬 오염과 권한 관리 |

NVIDIA가 이 흐름에 관심을 두는 이유는 명확합니다. 에이전트가 상시 실행되려면 모델 추론이 일회성 API 호출보다 더 지속적인 워크로드가 됩니다. 사용자가 잠든 사이에도 예약 작업을 확인하고, 메시징 앱에서 들어온 요청을 처리하고, 로컬 파일을 읽고, 도구 호출 기록을 남기고, 다음 작업을 위해 스킬을 정리해야 합니다. 이런 에이전트는 노트북에서 잠깐 돌리는 CLI보다 "항상 켜져 있는 작은 AI 서버"에 가깝습니다. NVIDIA가 DGX Spark를 agentic computer로 밀고 있는 이유도 여기에 있습니다.

DGX Spark playbook은 이 그림을 더 구체화합니다. Hermes와 로컬 LLM을 모두 DGX Spark에서 실행하면 대화와 데이터가 로컬에 남고, cloud API 비용 없이 Ollama 기반 모델을 붙일 수 있으며, Telegram 봇을 통해 휴대폰에서도 같은 에이전트에 접근할 수 있다고 설명합니다. NVIDIA는 DGX Spark가 Linux 기반이고, 128GB unified memory를 갖췄으며, 계속 켜두는 장치로 설계됐다는 점을 강조합니다. 단순히 "작은 슈퍼컴퓨터"라는 말보다 중요한 것은 운영 방식입니다. 이 장치는 사용자가 직접 쓰는 PC이면서 동시에 개인 에이전트를 붙잡아 두는 런타임이 됩니다.

물론 이 포지셔닝에는 하드웨어 판매 논리가 들어 있습니다. NVIDIA는 Qwen 3.6 35B가 약 20GB 메모리에서 실행되며 이전 120B급 모델을 넘는다고 주장하고, DGX Spark가 120B MoE 모델을 하루 종일 돌릴 수 있다고 설명합니다. 이 수치는 개발자에게 매력적으로 들립니다. 그러나 실무에서는 단일 benchmark보다 더 많은 변수가 있습니다. 어떤 양자화 포맷을 쓰는지, tool call 지연이 얼마나 되는지, 여러 에이전트가 동시에 같은 로컬 모델을 때릴 때 latency가 어떻게 변하는지, 로컬 저장소와 메시징 게이트웨이의 권한을 어떻게 격리하는지가 실제 품질을 좌우합니다.

Hermes의 더 큰 쟁점은 "self-improving"이라는 표현입니다. 이 단어는 조심해서 읽어야 합니다. 많은 사람이 self-improving을 모델이 스스로 가중치를 업데이트해 더 똑똑해지는 것으로 상상합니다. 하지만 Hermes가 공개적으로 설명하는 개선은 주로 에이전트 레이어의 개선입니다. 경험을 스킬로 저장하고, 그 스킬을 다시 쓰고, 기억을 검색하고, 사용자 취향과 반복 작업을 모델링하는 방식입니다. 이것은 유용할 수 있지만, 모델 학습과는 다릅니다. 가중치가 그대로라면 에이전트는 더 많은 절차와 문맥을 갖게 되는 것이지, 기본 모델 자체가 변하는 것은 아닙니다.

사용자의 요청과 로컬 파일, 메시징 입력

Hermes orchestration layer: 도구 선택, sub-agent 분리, 스킬 검색

로컬 LLM 실행: Ollama, RTX GPU, DGX Spark

결과, 실패 trace, 사용자 피드백을 메모리와 스킬로 저장

다음 요청에서 재사용하되, 평가와 권한 정책으로 회귀를 막아야 함

이 구분은 사소하지 않습니다. 로컬 에이전트가 자기 경험을 계속 저장한다면, 좋은 습관만 쌓이는 것이 아닙니다. 잘못된 해결책, 특정 환경에만 맞는 편법, 사용자의 순간적 피드백, 실패한 명령도 함께 축적될 수 있습니다. 에이전트가 만든 스킬이 다음 작업에서 자동으로 호출된다면, 한 번의 잘못된 일반화가 여러 작업으로 퍼질 수 있습니다. 그래서 self-improving agent에는 self-forgetting, skill pruning, regression test, approval policy가 같이 필요합니다. 기억하는 능력만 있고 잊는 능력이 없다면 장기 실행 에이전트는 점점 더 복잡한 프롬프트 더미가 될 수 있습니다.

커뮤니티에서도 비슷한 우려가 나옵니다. r/AI_Agents의 한 토론은 self-improving agent의 benchmark가 충분하지 않다고 지적했습니다. 반복 상호작용 뒤 오류가 줄어드는지, 같은 실수를 멈추는지, 한 사용자에게서 배운 내용이 다른 작업에도 전이되는지 같은 질문입니다. 특히 한 댓글은 메모리와 스킬 축적을 실제 모델 학습과 혼동하지 말아야 한다고 말합니다. 모델 가중치를 업데이트하지 않는다면 그것은 훈련이 아니라 문맥과 절차를 더 잘 공급하는 일에 가깝습니다. 이 비판은 Hermes만 겨냥한 것이 아니라, self-improving이라는 단어를 쓰는 에이전트 제품군 전체에 해당합니다.

개발자 입장에서 실용적인 해석은 이렇습니다. Hermes나 비슷한 로컬 에이전트를 도입한다면 "이 에이전트가 점점 똑똑해질 것인가"보다 "반복 작업의 성공 경로를 안전하게 재사용할 수 있는가"를 먼저 봐야 합니다. 예를 들어 매일 특정 저장소의 이슈를 요약하고, 빌드 로그를 확인하고, 정해진 문서 템플릿을 갱신하는 작업이라면 로컬 장기 기억과 스킬은 분명히 가치가 있습니다. 매번 같은 설정을 설명할 필요가 줄고, API 비용도 예측 가능해집니다. 반대로 법무 문서 판단, 보안 변경, 결제 실행처럼 오류 비용이 큰 작업에서는 에이전트가 스스로 만든 스킬을 무조건 신뢰하면 안 됩니다.

여기서 평가 설계가 핵심입니다. 좋은 self-improving loop에는 최소한 세 가지가 필요합니다. 첫째, 성공을 판정하는 외부 신호입니다. 코드라면 테스트와 타입체크가 될 수 있고, 데이터 처리라면 schema validation과 샘플 검수가 될 수 있습니다. 둘째, 스킬 변경의 이력과 rollback입니다. 에이전트가 만든 절차가 나빠졌을 때 이전 버전으로 돌아갈 수 있어야 합니다. 셋째, 권한 분리입니다. 파일 읽기, 명령 실행, 네트워크 접근, 메시징 발송, 결제 같은 행동은 같은 신뢰 수준으로 취급하면 안 됩니다. 로컬에서 실행된다는 것은 데이터가 외부로 덜 나간다는 장점이 있지만, 로컬 시스템을 직접 만진다는 뜻이기도 합니다.

NVIDIA의 입장에서 Hermes는 OpenClaw 이후의 자연스러운 확장입니다. OpenClaw는 로컬 에이전트와 agent computer라는 개념을 대중적으로 보여줬고, Hermes는 여기에 장기 기억과 스킬 개선이라는 언어를 붙입니다. NVIDIA가 특정 에이전트를 소유하지 않아도 괜찮습니다. RTX와 DGX Spark 위에서 돌아가는 에이전트가 많아질수록, "로컬에서 강한 모델을 계속 돌릴 수 있는 장비"의 수요가 생깁니다. 클라우드 모델이 아무리 강해져도, 개인 데이터와 장기 실행 워크플로를 로컬에 두고 싶은 사용자는 남습니다. 기업 역시 민감한 자료를 외부 API로 보내기 어렵거나, 비용과 latency를 통제해야 하는 팀에서는 로컬 에이전트 런타임을 검토할 수 있습니다.

다만 로컬 에이전트가 클라우드 에이전트를 대체한다고 보기는 어렵습니다. 더 현실적인 그림은 역할 분화입니다. 클라우드 에이전트는 가장 강한 모델, 대규모 병렬 실행, 관리형 샌드박스, 팀 거버넌스에 강합니다. 로컬 에이전트는 개인화, 데이터 통제, 상시 실행, 낮은 한계 비용에 강합니다. 실제 개발 조직은 둘을 섞을 가능성이 큽니다. 민감한 문서 정리와 반복 모니터링은 로컬 Hermes가 맡고, 큰 코드베이스 변경이나 고난도 추론은 Codex나 Claude Code 같은 클라우드 에이전트에 넘기는 식입니다.

Hermes 뉴스가 흥미로운 이유는 "새로운 에이전트가 나왔다"가 아닙니다. 이미 에이전트는 너무 많습니다. 중요한 변화는 에이전트의 실행 단위가 변하고 있다는 점입니다. 한 번의 채팅, 한 번의 CLI 실행, 한 개의 원격 작업 세션에서 벗어나, 에이전트가 장기 기억과 스킬 저장소를 가진 작은 운영체제처럼 움직이기 시작했습니다. NVIDIA는 그 운영체제가 계속 켜져 있을 하드웨어 자리를 노리고 있고, Nous Research는 그 위에서 에이전트가 경험을 절차로 바꾸는 구조를 밀고 있습니다.

그래서 이번 발표를 읽는 가장 좋은 질문은 "Hermes가 정말 스스로 배우는가"입니다. 답은 반쯤은 그렇고, 반쯤은 아직 검증이 필요하다는 쪽에 가깝습니다. 메모리와 스킬을 축적해 반복 작업을 더 잘 처리한다면 에이전트 레벨에서는 분명히 학습처럼 보입니다. 그러나 그 학습이 실제 성능 향상인지, 단지 더 많은 문맥을 집어넣은 결과인지, 특정 사용자의 습관에 과적합한 것인지는 별도로 측정해야 합니다. 앞으로 self-improving agent 경쟁의 승자는 더 멋진 데모를 보이는 쪽이 아니라, 개선을 평가하고 되돌리고 통제하는 시스템을 잘 만든 쪽일 가능성이 큽니다.

NVIDIA와 Hermes의 조합은 그 경쟁이 로컬 장비 위에서도 벌어질 수 있음을 보여줍니다. 에이전트가 업무의 일부가 아니라 사용자의 환경 일부가 될수록, 모델 크기보다 중요한 질문이 늘어납니다. 어디에서 실행되는가. 무엇을 기억하는가. 어떤 스킬을 만들 수 있는가. 누가 그 스킬을 검증하는가. 실패한 학습을 어떻게 지우는가. Hermes Agent는 이 질문들을 한 번에 해결한 완성품이라기보다, 로컬 self-improving agent라는 다음 실험장이 열리고 있음을 알리는 신호에 가깝습니다.