Honeycomb Agent Timeline, 에이전트 장애를 되감는 관측 계층

Honeycomb Agent Timeline은 AI 에이전트의 LLM 호출, 도구 사용, handoff, 시스템 장애를 하나의 production timeline으로 묶습니다.

- 무슨 일: Honeycomb이

Agent Timeline, Canvas Agent, Canvas Skills를 공개했습니다.- Agent Timeline은 Early Access이며, AI 에이전트의 LLM 호출·도구 사용·handoff·시스템 span을 시간순으로 재구성합니다.

- 핵심 의미: 에이전트 경쟁이 "실행"에서 "실행 후 설명 책임"으로 이동하고 있습니다.

- 개발자 영향: production agent에는 prompt log보다

OpenTelemetry기반 trace, retry, cost, downstream failure가 필요해집니다. - 주의점: 제품은 Honeycomb 고객과 Early Access 범위에 묶여 있고, "AI observability"는 아직 표준과 벤더 구현이 함께 움직이는 초기 시장입니다.

Honeycomb이 2026년 5월 12일 Agent Observability 발표를 내놨습니다. 새 기능의 이름은 Agent Timeline, Canvas Agent, Canvas Skills입니다. 표면적으로는 관측성 제품의 기능 업데이트처럼 보입니다. 하지만 이번 발표의 포인트는 더 넓습니다. AI 에이전트가 production에서 실제로 행동하기 시작하면, 개발팀은 "모델이 어떤 답을 냈는가"보다 "무엇을 실행했고, 왜 그 경로로 갔고, 어느 시스템에 영향을 줬는가"를 설명해야 합니다. Honeycomb은 이 문제를 대시보드가 아니라 시간순 재구성 문제로 잡았습니다.

AI 에이전트 운영의 어려움은 에이전트가 실패한다는 사실 자체가 아닙니다. 실패는 모든 소프트웨어에서 일어납니다. 문제는 실패의 모양이 낯설다는 데 있습니다. 사용자의 한 요청이 planner agent, retrieval agent, coding agent, approval agent, external API, database, queue, browser session, shell command로 흩어질 수 있습니다. 중간에 retry가 여러 번 발생하고, 한 agent의 판단이 다른 agent의 prompt로 들어가며, model call의 latency와 downstream API 장애가 서로 얽힙니다. 기존 APM 화면에서 HTTP 500 하나를 찾는 일과는 다른 종류의 조사입니다.

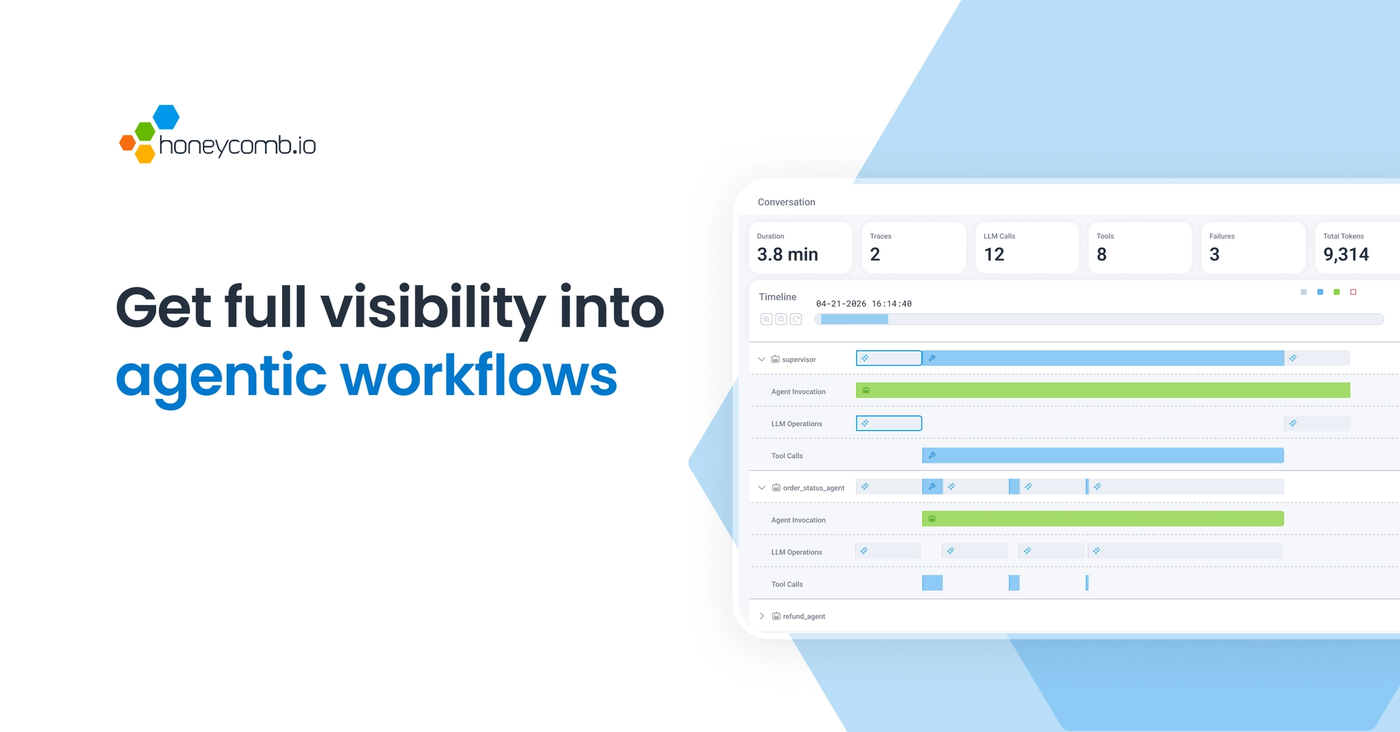

Honeycomb의 Agent Timeline은 바로 이 지점을 겨냥합니다. 제품 페이지 설명에 따르면 사용자는 하나의 agent conversation을 열고, 총 소요 시간, model call 수, tool call 수, retry, 참여 agent, failure를 요약 수준에서 본 뒤, 각 span으로 내려가 LLM operation, tool call, token usage, prompt detail, API call, database query, infrastructure behavior를 연결해 볼 수 있습니다. 즉 "LLM tracing"을 넘어서 agent behavior와 full-stack trace를 같은 investigation flow에 넣겠다는 주장입니다.

에이전트 시대의 장애는 대화처럼 생겼습니다

전통적인 소프트웨어 관측성은 request, service, metric, log, trace를 중심으로 발전했습니다. 사용자가 버튼을 누르면 request가 들어오고, backend service가 호출되고, database query가 실행됩니다. 물론 microservice 환경에서는 이것도 충분히 복잡합니다. 그래도 사건의 형태는 비교적 안정적입니다. request ID나 trace ID를 따라가면 어떤 service가 느렸는지, 어떤 query가 실패했는지, 어느 배포 이후 error rate가 올랐는지 찾을 수 있습니다.

AI 에이전트는 같은 request 안에서 더 많은 의미적 상태를 만듭니다. agent가 사용자의 요구를 해석하고, 계획을 만들고, 도구를 고르고, 중간 결과를 평가하고, 다른 agent에게 넘기고, 실패하면 다시 시도합니다. 여기서 중요한 정보는 단순히 "POST /tools/search가 1.2초 걸렸다"가 아닙니다. 왜 search tool을 골랐는지, 검색 결과를 어떻게 해석했는지, 어떤 조건 때문에 retry했는지, 어느 handoff에서 context가 빠졌는지, downstream API의 작은 장애가 최종 의사결정을 어떻게 바꿨는지가 중요합니다.

이런 사건은 로그의 줄이 아니라 대화의 흐름에 가깝습니다. 사용자 message, agent thought, model call, tool input, tool output, retry, agent handoff, system span이 서로 영향을 줍니다. 그래서 Honeycomb이 "timeline"이라는 표현을 선택한 것은 우연이 아닙니다. agent debugging은 waterfall 하나를 펼치는 것보다, 여러 agent의 행동을 시간축 위에서 재생하는 쪽에 가깝습니다.

Honeycomb이 공개한 세 가지 축

이번 발표의 첫 번째 축은 Agent Timeline입니다. Honeycomb은 이를 multi-agent, multi-trace workflow를 하나의 coherent view로 렌더링하는 기능이라고 설명합니다. 화면은 conversation-first 조사 흐름을 앞세웁니다. 사용자가 agent conversation ID를 열면 전체 duration, model call, tool call, retry, agent, failure를 요약하고, 필요하면 실패한 span이나 downstream system root cause로 내려갑니다. 제품 메시지의 핵심은 "agent가 무엇을 했는가"와 "시스템이 어떻게 반응했는가"를 분리하지 않는 것입니다.

두 번째 축은 Canvas Agent입니다. Canvas는 Honeycomb의 협업 조사 공간이자 chat interface이고, 이제 autonomous agent 역할까지 맡습니다. 발표문은 alert가 발생하거나 SLO가 타거나 anomaly가 보이면 Canvas Agent가 자동으로 데이터를 모으고, 가설을 만들고, 테스트하고, remediation을 제안할 수 있다고 설명합니다. 이것은 "AI를 관측하는 기능"과 "AI로 관측하는 기능"을 동시에 밀겠다는 방향입니다.

세 번째 축은 Canvas Skills입니다. Honeycomb은 Skills를 좋은 엔지니어의 debugging knowledge와 framework/service best practice를 재사용 가능한 playbook으로 인코딩하는 기능으로 설명합니다. Kafka 같은 특정 시스템을 조사할 때 어떤 질문을 던져야 하는지, 어떤 지표와 span을 함께 봐야 하는지, 어떤 가설 순서가 유효한지 agent가 반복 실행할 수 있게 만든다는 의미입니다.

발표에는 availability도 명확히 나옵니다. Canvas, Canvas Agent, Skills는 발표 다음 주부터 Honeycomb 고객에게 제공됩니다. Agent Timeline은 Early Access이며 다음 달 일반 제공이 예상됩니다. 따라서 오늘 당장 모든 개발팀이 같은 경험을 쓸 수 있는 단계는 아닙니다. 하지만 시장 신호는 분명합니다. 에이전트 운영의 핵심 판매 포인트가 "더 많은 자동화"만이 아니라 "자동화가 남긴 행동 기록의 해석"으로 이동하고 있습니다.

| 관측 대상 | 기존 APM 중심 사고 | Agent Timeline이 노리는 영역 |

|---|---|---|

| 단위 | request, service, endpoint, trace | conversation, agent, handoff, tool run |

| 실패 원인 | latency, error rate, dependency failure | 잘못된 tool 선택, retry loop, context loss, downstream degradation |

| 조사 방식 | dashboard, log search, trace waterfall | 시간순 agent replay와 full-stack span drilldown |

OpenTelemetry가 왜 중요해졌나

Honeycomb 발표에서 반복되는 단어는 OpenTelemetry입니다. 회사는 Agent Timeline과 관련 기능이 OpenTelemetry GenAI standards에 정렬되어 있어 proprietary SDK나 framework lock-in 없이 structured GenAI insight를 만들 수 있다고 말합니다. 이 대목은 제품 홍보 문구 이상으로 중요합니다. 에이전트 관측성이 벤더별 SDK에 갇히면 개발팀은 agent framework를 바꿀 때마다 telemetry schema를 다시 붙여야 합니다. 더 큰 문제는 여러 agent와 tool이 섞인 환경에서 공통 언어가 사라진다는 점입니다.

OpenTelemetry는 이미 전통적인 distributed tracing에서 표준 위치를 차지했습니다. AI 에이전트 영역에서도 비슷한 일이 벌어지고 있습니다. model provider, agent framework, vector database, MCP server, tool runtime, browser automation, workflow engine이 모두 telemetry를 내보낼 수 있어야 합니다. 여기서 span name, attribute, event semantics가 제각각이면 timeline은 금방 깨집니다. "LLM call"이라고 부르는 이벤트가 어느 곳에서는 prompt completion이고, 다른 곳에서는 tool execution까지 포함한다면, production incident에서 재구성은 더 어려워집니다.

Honeycomb은 이 점을 잘 알고 있습니다. 회사는 2026년 4월 OpenTelemetry와 AI feedback loop를 다룬 글에서 GenAI semantic conventions가 agent, LLM, MCP, tool을 관측하기 위한 trace span과 event naming pattern을 정의한다고 설명했습니다. Agent Timeline은 이 흐름을 제품화한 사례로 볼 수 있습니다. AI observability가 단순히 prompt와 response를 저장하는 기능에서, 표준화된 distributed system telemetry 문제로 바뀌고 있다는 뜻입니다.

물론 표준을 말한다고 자동으로 interoperability가 생기지는 않습니다. GenAI semantic conventions는 계속 변하고 있고, framework마다 구현 깊이가 다릅니다. 비용, token usage, prompt redaction, tool input 보존, 개인정보 삭제 정책도 제품마다 다르게 처리됩니다. 그래서 개발팀은 "OpenTelemetry 지원"이라는 체크박스만 볼 것이 아니라, agent handoff와 tool result, retry, cost, safety event까지 실제로 어떤 attribute로 남는지 확인해야 합니다.

왜 지금 이 뉴스가 나왔나

2026년의 엔터프라이즈 AI 발표를 보면 공통 패턴이 있습니다. AI 에이전트를 더 똑똑하게 만드는 발표만큼이나, 에이전트를 통제하고 배포하고 감시하는 발표가 늘고 있습니다. Red Hat은 개발자 도구와 로컬 sandbox를 강조했고, UiPath는 코딩 에이전트 orchestration과 governance를 내세웠습니다. Veeam은 데이터와 복구 계층을 에이전트 신뢰의 기반으로 잡았습니다. Honeycomb은 같은 흐름에서 관측성을 맡습니다.

이 흐름은 자연스럽습니다. 데모 단계의 에이전트는 성공 화면만 보여주면 됩니다. production의 에이전트는 실패했을 때 설명할 수 있어야 합니다. 고객의 계정을 바꿨는지, 잘못된 문서를 읽었는지, 결제 tool을 호출했는지, cloud resource를 만들었는지, 민감한 데이터를 prompt에 넣었는지 증명해야 합니다. "모델이 그렇게 판단했습니다"는 운영 답변이 될 수 없습니다.

특히 agentic workflow는 governance와 observability가 분리되기 어렵습니다. 관측성이 없으면 정책 위반을 찾을 수 없고, 정책을 적용하려면 어떤 행동이 일어났는지 실시간 또는 사후에 알아야 합니다. 예를 들어 에이전트가 비용이 큰 model call을 반복하거나, 승인 없이 destructive command를 실행하려 하거나, retriever가 오래된 정책 문서를 가져온다면 단순 error rate로는 잡기 어렵습니다. 필요한 것은 행동 단위의 trace와 그 trace를 해석하는 도구입니다.

커뮤니티의 회의론도 같이 봐야 합니다

Honeycomb의 방향이 흥미롭다고 해서, 모든 메시지를 그대로 받아들일 필요는 없습니다. Honeycomb은 이전부터 "AI가 observability의 본질을 바꾼다"는 강한 주장을 해왔고, 이 주장은 커뮤니티에서 양쪽 반응을 얻었습니다. GeekNews에는 Honeycomb 관련 글이 "LLM이 분석을, OpenTelemetry가 계측을 평준화한다"는 요지로 소개됐습니다. 빠른 feedback loop와 사람-AI 협업이 중요하다는 주장에는 설득력이 있습니다.

반면 Hacker News 토론에서는 더 냉정한 반응도 있었습니다. 실제 Honeycomb을 좋아하고 쓰는 사용자들도 있지만, "AI가 그래프를 보면 문제 해결이 거의 끝난다"는 식의 메시지는 과장이라는 비판이 나왔습니다. telemetry를 수집하고 저장하고 쿼리 가능한 형태로 유지하는 일은 여전히 어렵고, AI가 가설을 빠르게 던져도 사람이 검증해야 할 때가 많다는 지적입니다. 이 비판은 Agent Timeline에도 적용됩니다. timeline이 있으면 재구성은 쉬워지지만, 원인 판단과 remediation의 책임까지 자동으로 사라지는 것은 아닙니다.

Reddit의 agent observability 논의도 비슷합니다. 많은 개발자가 "agent observability가 아직 LLM tracing에 머무른다"고 지적합니다. prompt와 response만 저장하면 실제 failure mode를 놓칩니다. state transition, memory lineage, handoff payload, tool error, cost anomaly, retry loop, approval boundary가 같이 보여야 합니다. Honeycomb의 발표가 의미 있는 이유는 이 방향을 제품 메시지로 전면에 세웠기 때문입니다. 동시에 아직 Early Access라는 점은, 실제 사용자가 기대하는 깊이까지 구현됐는지 검증이 필요하다는 뜻입니다.

경쟁은 LLMOps에서 AgentOps로 이동합니다

몇 년 전 LLMOps 도구의 기본 단위는 prompt, completion, evaluation, dataset, model version이었습니다. LangSmith, Langfuse, Arize Phoenix, Humanloop, Weights & Biases 같은 도구가 prompt tracing과 evaluation workflow를 제공했습니다. 이 영역은 여전히 중요합니다. 하지만 agentic application이 늘어나면서 단위가 바뀌고 있습니다. 이제는 단일 completion보다 multi-step run, graph execution, tool result, external side effect, human approval이 중요합니다.

Honeycomb은 전통적인 observability 회사라는 점에서 LLMOps 도구와 출발점이 다릅니다. 강점은 high-cardinality telemetry, distributed tracing, production system debugging입니다. 약점은 agent framework와 prompt/eval ecosystem에서 specialist 도구만큼 깊은 기능을 제공할 수 있는지 아직 확인해야 한다는 점입니다. Datadog이나 Grafana 같은 범용 APM 벤더도 AI와 LLM observability를 강화하고 있고, 오픈소스 진영은 OpenTelemetry 기반으로 빠르게 움직입니다.

따라서 이 시장은 한 제품이 전부 먹는 형태보다는 계층화될 가능성이 큽니다. application developer는 LangGraph나 OpenAI Agents SDK, Vercel AI SDK, CrewAI, AutoGen 같은 framework에서 run trace를 남깁니다. observability backend는 그 trace를 OpenTelemetry로 받고, LLMOps layer는 prompt version과 eval을 관리합니다. governance layer는 policy violation과 approval을 봅니다. Honeycomb의 Agent Timeline은 이 중 production debugging과 system impact 연결에 강하게 포지셔닝합니다.

개발팀이 당장 점검할 것

이번 뉴스를 "Honeycomb을 써야 하나"라는 구매 질문으로만 읽으면 좁습니다. 더 중요한 질문은 지금 만들고 있는 AI 에이전트가 나중에 설명 가능한 흔적을 남기고 있는가입니다. 데모에서는 console log와 agent transcript만으로 충분해 보입니다. production에서는 부족합니다. tool call input과 output, model name, token usage, cost, latency, retry count, external request, human approval, policy decision, redaction event가 추적되어야 합니다.

첫째, agent run ID와 trace ID를 연결해야 합니다. 사용자가 하나의 작업을 요청했을 때 agent framework 안의 run과 backend system의 distributed trace가 끊기면, 장애가 발생했을 때 두 화면을 손으로 맞춰야 합니다. Agent Timeline이 보여주는 방향은 conversation-level ID에서 system span으로 내려가는 흐름입니다. 자체 구축을 하더라도 이 연결은 초기에 설계하는 편이 낫습니다.

둘째, tool call을 단순 log가 아니라 span으로 남겨야 합니다. tool 이름, input schema, output size, error type, retry, permission boundary가 나와야 합니다. 특히 에이전트가 실제 시스템을 변경한다면 read-only tool과 write tool을 구분해야 하고, approval 상태도 telemetry에 들어가야 합니다. 나중에 사고가 났을 때 "어떤 tool이 실행됐나"와 "누가 승인했나"는 감사의 첫 질문이 됩니다.

셋째, prompt와 output 보존 정책을 명확히 해야 합니다. 관측성을 위해 모든 prompt를 저장하면 개인정보와 영업비밀 리스크가 커집니다. 반대로 아무것도 저장하지 않으면 debugging이 불가능합니다. redaction, sampling, retention, access control을 telemetry 설계와 함께 다뤄야 합니다. agent observability는 단순 기술 기능이 아니라 보안 정책입니다.

넷째, 평균 지표에 속지 않아야 합니다. agent workflow의 실패는 평균 latency나 평균 token cost에 잘 드러나지 않을 수 있습니다. 특정 agent가 특정 customer segment에서만 retry loop에 빠지거나, 특정 tool 결과가 오래된 데이터일 때만 잘못된 결정을 내릴 수 있습니다. high-cardinality query와 outlier 탐색이 중요한 이유입니다.

"AI로 관측"과 "AI를 관측"은 서로를 필요로 합니다

Honeycomb이 흥미로운 지점은 두 방향을 동시에 밀고 있다는 점입니다. Agent Timeline은 AI를 관측합니다. Canvas Agent와 Skills는 AI로 관측합니다. 전자는 agent behavior를 드러내고, 후자는 production incident 조사를 agent에게 맡기려 합니다. 이 둘은 따로 떨어지지 않습니다. 관측용 agent가 좋은 가설을 세우려면 agent와 system의 trace를 잘 읽어야 하고, agent가 조사한 내용도 다시 trace와 timeline으로 남아야 합니다.

이 구조는 앞으로 많은 운영 도구에서 반복될 가능성이 큽니다. 보안에서는 AI agent가 alert를 triage하지만, 그 agent의 판단도 audit trail로 남아야 합니다. 데이터 플랫폼에서는 AI agent가 pipeline failure를 분석하지만, 어떤 query와 sample을 봤는지 기록해야 합니다. 코딩 에이전트에서는 agent가 bug fix PR을 만들지만, 어떤 로그와 test failure를 근거로 수정했는지 추적해야 합니다. AI가 운영자를 돕는 순간, AI 자신도 운영 대상이 됩니다.

여기서 중요한 균형은 "자동화"와 "책임"입니다. 자동 조사와 자동 remediation은 매력적입니다. 하지만 production에서 자동화가 커질수록 사후 설명과 rollback, approval이 더 중요해집니다. Honeycomb의 발표는 이 긴장을 잘 보여줍니다. 에이전트가 빠르게 움직일수록, 사람이 나중에 되감을 수 있는 timeline이 필요합니다.

아직 남은 질문

첫 번째 질문은 구현 깊이입니다. 제품 페이지는 Agent Timeline이 conversation, agent lane, span, failure filter, downstream root cause를 보여준다고 설명합니다. 실제로 다양한 framework와 model provider, MCP server, workflow engine에서 얼마나 일관된 telemetry를 받을 수 있는지는 현장 검증이 필요합니다. "OpenTelemetry aligned"와 "바로 쓸 수 있는 integration" 사이에는 큰 차이가 있습니다.

두 번째 질문은 비용입니다. agent workflow는 telemetry도 많이 만듭니다. 모든 model call, tool call, prompt detail, token usage, downstream span을 저장하면 데이터량이 빠르게 늘어납니다. Honeycomb은 high-cardinality unified datastore를 강점으로 내세우지만, 고객 입장에서는 retention, sampling, redaction, storage cost를 함께 봐야 합니다. 관측성이 좋을수록 비용과 개인정보 표면도 커집니다.

세 번째 질문은 경쟁사의 대응입니다. Datadog, Grafana, New Relic, LangSmith, Langfuse, Arize 등은 모두 agent observability라는 단어를 다른 각도에서 해석할 수 있습니다. 어떤 도구는 production trace에 강하고, 어떤 도구는 eval과 prompt versioning에 강하고, 어떤 도구는 open-source self-hosting에 강합니다. Honeycomb은 production debugging의 언어로 이 시장을 잡으려 하지만, 구매자는 자신의 agent maturity와 운영 리스크에 맞춰 계층을 조합하게 될 가능성이 큽니다.

결론: 에이전트의 블랙박스는 제품 기능이 아니라 운영 부채입니다

Honeycomb Agent Timeline이 중요한 이유는 에이전트 관측성을 하나의 부가 기능이 아니라 production 운영의 기본 계층으로 끌어올렸기 때문입니다. AI 에이전트가 실제 시스템을 읽고 쓰고 수정하고 배포하고 고객과 대화한다면, 그 행동은 나중에 되감을 수 있어야 합니다. transcript만으로는 부족합니다. prompt log만으로도 부족합니다. agent handoff와 tool call, retry, cost, downstream system span이 같은 시간축 위에 있어야 합니다.

이 발표는 Honeycomb만의 이야기가 아닙니다. 에이전트 시장 전체가 같은 방향으로 가고 있습니다. 모델은 더 빠르게 행동하고, agent framework는 더 많은 tool을 붙이고, 기업은 더 많은 업무를 위임하려 합니다. 그러면 질문은 자연스럽게 바뀝니다. "에이전트가 할 수 있나" 다음에는 "에이전트가 한 일을 설명할 수 있나"가 옵니다. Honeycomb의 답은 timeline입니다. 다른 벤더는 다른 답을 내놓을 수 있습니다. 하지만 production AI 팀에게 블랙박스 에이전트는 더 이상 멋진 데모가 아니라 운영 부채입니다.