Honeycomb이 AI 에이전트의 블랙박스를 시간선으로 열었다

Honeycomb Agent Observability 출시는 AI 에이전트 운영의 병목이 모델 호출 로그가 아니라 handoff, tool call, 비용, 장애 재구성으로 이동했음을 보여줍니다.

- 무슨 일: Honeycomb이 2026년 5월 12일

Agent Timeline,Canvas Agent,Canvas Skills를 포함한 Agent Observability 기능군을 공개했습니다.- Agent Timeline은 early access로 제공되고, Canvas 계열 기능은 고객에게 즉시 제공된다고 발표됐습니다.

- 의미: 에이전트 운영의 핵심 질문이 "응답이 맞았나"에서 "어떤 도구를 왜 호출했고, 어디서 시스템에 영향을 줬나"로 바뀌고 있습니다.

- 개발자 영향:

OpenTelemetry GenAIspan, handoff, retry, token cost, downstream trace를 같은 사건 기록으로 설계해야 합니다.- 단일 LLM call 추적만으로는 multi-agent 장애, 비용 폭주, 잘못된 외부 side effect를 설명하기 어렵습니다.

- 주의점: 관측성 도구가 곧 안전장치는 아닙니다. 어떤 state transition과 권한 경계를 기록할지 먼저 정해야 합니다.

Honeycomb이 5월 12일 발표한 Agent Observability는 화려한 모델 출시 뉴스는 아닙니다. 새 LLM이 몇 점을 올렸다는 이야기도 아니고, 특정 코딩 에이전트가 벤치마크에서 Claude나 GPT를 넘었다는 이야기도 아닙니다. 그런데 지금 AI 개발팀에게는 이런 발표가 점점 더 중요해지고 있습니다. 에이전트를 데모에서 움직이는 단계는 빠르게 평준화되고 있고, 진짜 병목은 프로덕션에서 에이전트가 무엇을 했는지 나중에 설명할 수 있는가로 옮겨가고 있기 때문입니다.

Honeycomb의 공식 발표는 Agent Timeline, 재구축된 Canvas, Canvas Agent, Canvas Skills를 한꺼번에 묶어 공개했습니다. 제품 이름만 보면 기존 observability 제품에 AI 기능을 덧댄 것처럼 보일 수 있습니다. 하지만 발표문과 제품 페이지를 같이 읽으면 메시지는 더 구체적입니다. LLM 호출 로그를 예쁘게 보여주는 것이 아니라, 에이전트의 판단, 도구 호출, 에이전트 간 handoff, 그리고 그 결과로 발생한 데이터베이스 쿼리나 API 호출을 하나의 시간선으로 묶겠다는 선언입니다.

최근 AI 에이전트 인프라 뉴스의 공통점은 "실행"입니다. Red Hat은 Ansible을 통해 에이전트가 인프라를 직접 만지는 방식을 통제하려 하고, Salesforce는 Agentforce와 Tableau MCP를 통해 여러 업무 에이전트를 묶으려 합니다. Honeycomb의 발표는 그 다음 질문을 던집니다. 에이전트가 실행을 시작한 뒤, 우리는 무엇을 볼 수 있어야 할까요. 성공처럼 보인 작업이 실제로는 잘못된 도구 입력, 반복 retry, 다운스트림 API 지연, 과도한 토큰 비용, 누락된 권한 검증을 남겼다면, 운영자는 그 경로를 재구성할 수 있어야 합니다.

에이전트 관측성은 LLM 로그 뷰어가 아닙니다

LLM 애플리케이션의 초기 관측성은 비교적 단순했습니다. prompt, completion, latency, token usage, model name, error 정도를 저장하면 대부분의 질문에 답할 수 있었습니다. 사용자가 질문하고 모델이 답하는 구조에서는 하나의 요청과 하나의 응답 사이를 보면 됩니다. 비용이 높으면 모델을 바꾸고, 품질이 낮으면 prompt나 retrieval을 바꾸고, 지연이 크면 streaming이나 cache를 조정할 수 있었습니다.

에이전트는 다릅니다. 에이전트는 질문에 답하는 동시에 계획을 세우고, 도구를 고르고, 외부 시스템을 읽고, 때로는 변경합니다. 한 에이전트가 CRM에서 고객 정보를 읽고, 다른 에이전트가 주문 상태를 확인하고, 세 번째 에이전트가 환불 정책을 적용한다고 가정해 보겠습니다. 사용자에게 최종 응답이 정상적으로 반환돼도 내부에서는 고객 등급을 잘못 해석했거나, 특정 tool call이 timeout 뒤 재시도됐거나, 한 handoff에서 중요한 필드가 summary에 빠졌을 수 있습니다. 이때 "마지막 응답이 괜찮았다"는 사실은 운영 관점에서 거의 충분하지 않습니다.

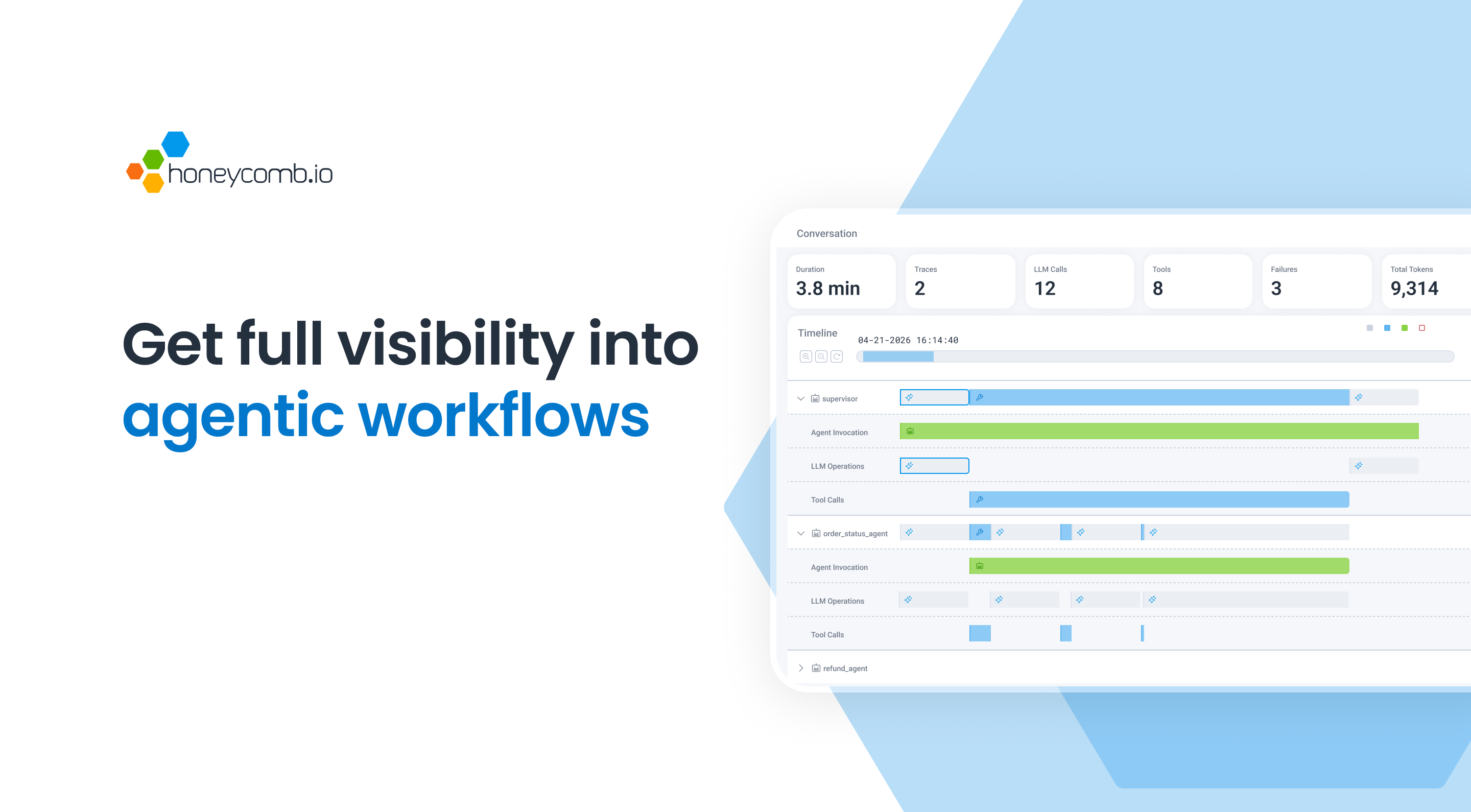

Honeycomb이 Agent Timeline에서 강조하는 것도 이 지점입니다. 제품 페이지는 conversation ID를 기준으로 전체 duration, model calls, tool calls, retries, involved agents, failures를 summary level에서 보여준다고 설명합니다. 더 중요한 것은 horizontal swim lane입니다. 단일 waterfall trace는 순차적인 서비스 호출에는 익숙하지만, 병렬 에이전트와 교차 handoff에는 잘 맞지 않습니다. 에이전트 시스템의 실패는 종종 "어느 한 span이 빨갛다"가 아니라 "Agent A의 요약이 Agent B의 전제를 바꿨고, Agent B가 안전하지 않은 도구 호출을 허용했다" 같은 형태로 나타납니다.

| 관측 대상 | 단일 LLM 앱 | 프로덕션 에이전트 |

|---|---|---|

| 핵심 단위 | prompt와 completion | run, step, tool call, handoff, side effect |

| 실패 모드 | 환각, 지연, 비용 증가 | loop, 잘못된 도구 입력, 누락된 state, 권한 경계 침범 |

| 디버깅 질문 | 왜 이런 답을 했나 | 왜 이 행동을 안전하다고 판단했나 |

| 운영 신호 | latency, token, error | handoff 품질, retry 경로, downstream span, human override |

Agent Timeline이 겨냥하는 문제

Honeycomb의 Agent Timeline 설명에서 가장 눈에 띄는 문장은 "AI와 non-AI 정보를 한 곳에 놓는다"는 부분입니다. 이것은 단순한 UI 주장처럼 보이지만, 에이전트 운영에서는 핵심입니다. 에이전트 장애는 모델 층에서만 끝나지 않습니다. 모델이 느린 도구를 골랐는지, 도구 자체가 느렸는지, 외부 API가 degraded 상태였는지, 데이터베이스 쿼리가 특정 tenant에서만 느렸는지, agent handoff가 잘못된 customer id를 넘겼는지 모두 같은 사건으로 묶여야 합니다.

기존 APM은 API, database, queue, browser 같은 소프트웨어 시스템의 실행 경로를 잘 보여줍니다. 반대로 LLM tracing 도구는 prompt, completion, retrieval, eval 같은 모델 중심 신호를 잘 보여줍니다. 문제는 에이전트가 둘 사이를 연결한다는 점입니다. 에이전트는 모델 호출이면서 동시에 운영자입니다. 자연어로 추론하고, API를 호출하고, 상태를 바꾸고, 다음 에이전트에게 요약을 넘깁니다. 따라서 에이전트 관측성은 "LLM observability"와 "full-stack observability" 사이의 어딘가에 있으면 부족합니다. 두 층을 한 run id와 같은 사건 모델로 묶어야 합니다.

Honeycomb은 이 지점을 자사 강점과 연결합니다. 이 회사는 원래 high-cardinality event와 trace 기반 observability를 강조해 왔고, "unknown unknowns"를 찾는다는 메시지를 오래 사용했습니다. 에이전트는 이 메시지와 잘 맞습니다. 예측 가능한 오류 코드보다 예측하지 못한 경로가 더 많기 때문입니다. 같은 사용자 요청이라도 agent memory, retrieved context, tool availability, model sampling, policy response에 따라 실행 경로가 달라질 수 있습니다. 운영자가 필요한 것은 평균 latency 그래프 하나가 아니라, 특정 run이 어떻게 갈라졌고 어느 지점에서 전제가 바뀌었는지 보는 능력입니다.

Canvas Agent와 Skills는 운영 지식을 에이전트에게 넘기는 실험입니다

이번 발표에서 Agent Timeline이 "무엇이 일어났는지 본다"에 가깝다면, Canvas Agent와 Canvas Skills는 "관측성 데이터를 바탕으로 어떻게 조사할지"에 가깝습니다. Canvas 문서는 자연어 질문을 Honeycomb query로 바꾸고, trace, log, metric을 분석하며, follow-up 질문으로 조사를 이어갈 수 있다고 설명합니다. 발표에서 새로 강조된 Canvas Agent는 alert나 SLO burn 같은 trigger가 발생했을 때 자동으로 조사를 시작하는 방향입니다.

여기서 흥미로운 것은 Skills입니다. Honeycomb은 이미 Agent Skills 문서에서 query-patterns, production-investigation, slos-and-triggers, otel-instrumentation, otel-migration 같은 skill을 제공한다고 설명합니다. 이것은 "에이전트에게 관측성 도구를 연결한다"에서 한 발 더 나아간 접근입니다. 단순히 MCP 서버를 붙여 query를 날릴 수 있게 하는 것이 아니라, 조직의 디버깅 방법론과 instrumentation 관습을 재사용 가능한 playbook으로 넘기는 방식입니다.

물론 이 접근에는 긴장도 있습니다. 자동 조사 에이전트는 운영자의 시간을 줄일 수 있지만, 잘못 설계되면 비용을 태우며 표면적인 가설만 생산할 수도 있습니다. Reddit의 AI SRE summit 메모에서도 incident agent가 한 사건당 수십 달러의 토큰 비용을 쓰고도 유용한 결론을 내지 못할 수 있다는 우려가 나왔습니다. 이 문제는 모델 성능만으로 풀리지 않습니다. 어떤 trigger에서 자동 조사를 시작할지, 어느 데이터셋까지 접근할지, 어떤 query는 읽기 전용으로 제한할지, 비용 budget을 어디서 끊을지 같은 운영 정책이 필요합니다.

OpenTelemetry GenAI 표준화가 중요한 이유

이번 발표에서 지나치기 쉬운 대목은 OpenTelemetry입니다. Honeycomb은 발표문에서 OpenTelemetry GenAI semantic conventions v1.40.0을 플랫폼에 통합했다고 밝혔습니다. OpenTelemetry 문서는 GenAI 관측 신호를 events, exceptions, metrics, model spans, agent spans로 나눕니다. Anthropic, AWS Bedrock, Azure AI Inference, OpenAI 같은 provider별 convention과 MCP convention도 연결합니다.

다만 문서상 GenAI semantic conventions의 status는 아직 Development입니다. 이는 실무자에게 두 가지 의미를 갖습니다. 첫째, agent observability를 vendor SDK 하나에 완전히 묶어두기에는 이른 시기입니다. 둘째, 그렇다고 자체 JSON 로그를 마음대로 남기면 나중에 migration 비용이 커집니다. 지금 필요한 것은 표준의 방향을 따라가되, 조직의 에이전트 실행 모델에 맞는 내부 event schema를 명확히 잡는 일입니다.

예를 들어 최소한 다음 질문에는 답할 수 있어야 합니다. 하나의 user request가 어떤 agent run으로 이어졌는가. 각 step은 어떤 model, prompt template, retrieval context, tool input을 사용했는가. tool output은 다음 step에 원문으로 전달됐는가, 요약으로 전달됐는가. 외부 시스템에 쓰기 작업이 있었다면 어떤 권한과 policy 판단을 거쳤는가. 사람이 override하거나 승인한 지점은 어디인가. 실패가 발생했을 때 retry가 같은 model로 반복됐는가, 더 싼 model이나 retrieval-only mode로 내려갔는가.

이 질문은 Honeycomb만의 문제가 아닙니다. LangSmith, Langfuse, Arize Phoenix, Helicone 같은 도구를 쓰더라도 같은 문제를 만납니다. 커뮤니티 반응에서 반복적으로 나오는 말도 비슷합니다. 도구 이름보다 run id, handoff snapshot, state transition, external side effect, human correction을 어떻게 기록하는지가 더 중요하다는 것입니다. 에이전트 관측성 시장은 아직 도구 경쟁처럼 보이지만, 실제 승부는 schema discipline에서 갈릴 가능성이 큽니다.

에이전트 장애는 조용히 나빠집니다

에이전트 운영이 까다로운 이유는 장애가 항상 폭발적으로 드러나지 않기 때문입니다. 전통적인 시스템에서는 CPU가 급증하거나 error rate가 튀거나 queue가 쌓이면 비교적 명확한 신호가 나옵니다. 에이전트는 더 조용히 나빠질 수 있습니다. 답변은 계속 나오지만 refund policy를 조금씩 잘못 적용합니다. 비용은 매일 조금씩 올라가지만 어떤 customer cohort에서만 발생합니다. handoff summary에서 특정 필드가 누락되지만 downstream agent가 그 빈칸을 그럴듯한 추론으로 채웁니다.

이런 실패는 단일 error span으로 잡히지 않습니다. "모델 호출 성공", "도구 호출 성공", "응답 반환 성공"이라는 초록색 상태가 이어져도 실제 업무 결과는 틀릴 수 있습니다. 그래서 Agent Timeline이 failure를 first-class citizen으로 다루겠다는 메시지는 중요합니다. 공식 제품 페이지는 conversation level의 failure count, failing span의 red highlight, failures only mode를 언급합니다. 이것이 충분한지는 별개 문제지만, 적어도 에이전트 장애를 단일 예외가 아니라 사건 재구성의 문제로 보고 있다는 신호입니다.

운영팀 입장에서는 여기서 두 종류의 지표를 분리해야 합니다. 하나는 시스템 지표입니다. latency, error, token, retry, cost, timeout, queue depth 같은 것들입니다. 다른 하나는 의미 지표입니다. agent가 어떤 전제를 세웠는지, 어떤 confidence를 붙였는지, 어떤 policy rule을 통과했는지, 어떤 handoff 정보가 downstream decision을 바꿨는지입니다. 전자는 기존 observability가 잘 다루는 영역이고, 후자는 LLM/agent tracing이 새로 다뤄야 하는 영역입니다. 프로덕션 에이전트는 둘 중 하나만으로 운영할 수 없습니다.

실무 팀은 무엇을 준비해야 하나

Honeycomb의 발표를 특정 제품 구매 뉴스로만 읽으면 놓치는 것이 있습니다. 더 큰 변화는 에이전트 프로젝트의 체크리스트가 바뀌고 있다는 점입니다. 지금까지 많은 팀은 모델 선택, RAG 품질, tool calling 성공률, eval score를 먼저 봤습니다. 앞으로는 "운영 가능한 에이전트인가"를 더 일찍 물어야 합니다. 그리고 운영 가능성은 대체로 코드를 다 만든 뒤 붙일 수 있는 기능이 아닙니다. 처음부터 run model, span model, 권한 모델, 비용 모델을 같이 설계해야 합니다.

가장 먼저 정할 것은 correlation입니다. user request, agent run, model call, tool call, downstream service trace가 같은 사건으로 연결돼야 합니다. 그 다음은 handoff입니다. 에이전트 간 요약이 단순 자연어 blob으로만 남으면 나중에 무엇이 사라졌는지 알기 어렵습니다. 핵심 필드는 구조화하고, 요약문과 원본 참조를 분리하고, 누가 어떤 정보를 근거로 다음 행동을 허용했는지 남겨야 합니다.

세 번째는 budget입니다. 에이전트는 사람보다 빨리 반복할 수 있고, 그 반복은 비용으로 전환됩니다. 비용 budget은 월말 결산 지표가 아니라 run-time guardrail이어야 합니다. 특정 incident 조사에서 모델 호출 횟수, tool call 횟수, expensive model 사용 횟수, wall-clock 시간을 제한하고, 한계를 넘으면 사람에게 넘기거나 저비용 모드로 전환해야 합니다.

네 번째는 side effect입니다. 읽기 전용 agent와 쓰기 가능한 agent는 완전히 다른 운영 대상입니다. 외부 시스템에 변경을 만드는 tool call은 별도 span, 별도 audit event, 별도 approval state를 가져야 합니다. "에이전트가 고객에게 답했다"와 "에이전트가 고객 계정을 변경했다"는 같은 관측성 정책으로 다룰 수 없습니다.

관측성은 안전의 필요조건이지 충분조건은 아닙니다

Honeycomb의 발표가 중요한 이유는 에이전트 운영 논의가 더 현실적으로 바뀌고 있다는 점입니다. 하지만 관측성이 곧 안전을 보장하지는 않습니다. 관측성은 일이 벌어진 뒤 설명할 수 있게 하고, 반복되는 실패를 줄일 수 있게 하며, 자동 조사의 입력을 제공합니다. 그러나 잘못된 권한 설계, 부실한 eval, 민감 데이터 노출, 과도한 자동 실행 범위는 관측성만으로 막을 수 없습니다.

오히려 관측성이 강해질수록 더 많은 민감 정보가 telemetry에 남을 위험도 생깁니다. prompt, completion, tool input, tool output, retrieved document, customer id, internal ticket, database query가 모두 trace에 들어간다면 observability backend 자체가 중요한 보안 경계가 됩니다. 따라서 AI agent telemetry를 설계할 때는 "많이 남기자"가 답이 아닙니다. 무엇을 원문으로 남기고, 무엇을 hash나 reference로 남기고, 무엇을 redaction할지 정해야 합니다. OpenTelemetry convention을 따르는 것과 데이터 최소화를 지키는 것은 별개의 설계 과제입니다.

이 점에서 Honeycomb의 Canvas 문서가 privacy와 permission boundary를 언급하는 것은 긍정적입니다. Canvas는 Honeycomb workspace 내부 데이터와 기존 access control을 전제로 동작한다고 설명합니다. 그러나 고객사 입장에서는 그 설명만으로 충분하지 않습니다. 자사 agent telemetry에 PII가 들어가는지, prompt에 영업 비밀이 포함되는지, 자동 조사 agent가 어떤 dataset을 조회할 수 있는지, 조사 결과를 팀 전체에 공유해도 되는지까지 별도로 점검해야 합니다.

결론: 에이전트 시대의 운영 표준이 형성되고 있습니다

Honeycomb Agent Observability 출시는 하나의 제품 업데이트이지만, 더 크게는 에이전트 운영 표준이 형성되는 장면입니다. 초기 LLM 앱은 prompt와 completion을 기록하는 것으로 충분해 보였습니다. 지금의 에이전트 시스템은 run, step, handoff, tool call, token cost, downstream span, policy decision, human override를 함께 봐야 합니다. 개발팀과 SRE팀이 같은 사건을 다른 화면에서 따로 해석하는 방식으로는 점점 버티기 어려워질 것입니다.

이 발표가 Honeycomb에게 실제 경쟁 우위를 줄지는 아직 봐야 합니다. LangSmith, Langfuse, Arize Phoenix, Datadog, New Relic, Grafana 계열 도구도 같은 문제를 향해 움직이고 있습니다. OpenTelemetry GenAI convention도 아직 안정화 과정에 있습니다. 하지만 방향은 분명합니다. 프로덕션 에이전트의 신뢰성은 모델 벤치마크만으로 설명되지 않습니다. 어떤 일을 했는지, 왜 했는지, 무엇을 바꿨는지, 어디서 멈춰야 했는지를 남기는 팀이 더 빨리 학습합니다.

AI 에이전트가 개발팀의 일부가 된다면, 그 에이전트도 온콜의 일부가 됩니다. 온콜에 들어온 시스템은 로그가 아니라 사건 기록을 가져야 합니다. Honeycomb이 이번 발표로 던진 메시지는 바로 그 지점입니다. 에이전트가 프로덕션에서 일한다면, 에이전트의 시간선도 프로덕션 자산입니다.