Copilot 앱 프리뷰, GitHub가 노리는 에이전트 작업대

GitHub Copilot app 기술 프리뷰는 코딩 에이전트 세션, 검증, PR, 자동화를 GitHub 작업 단위로 모으려는 시도입니다.

- 무슨 일: GitHub이

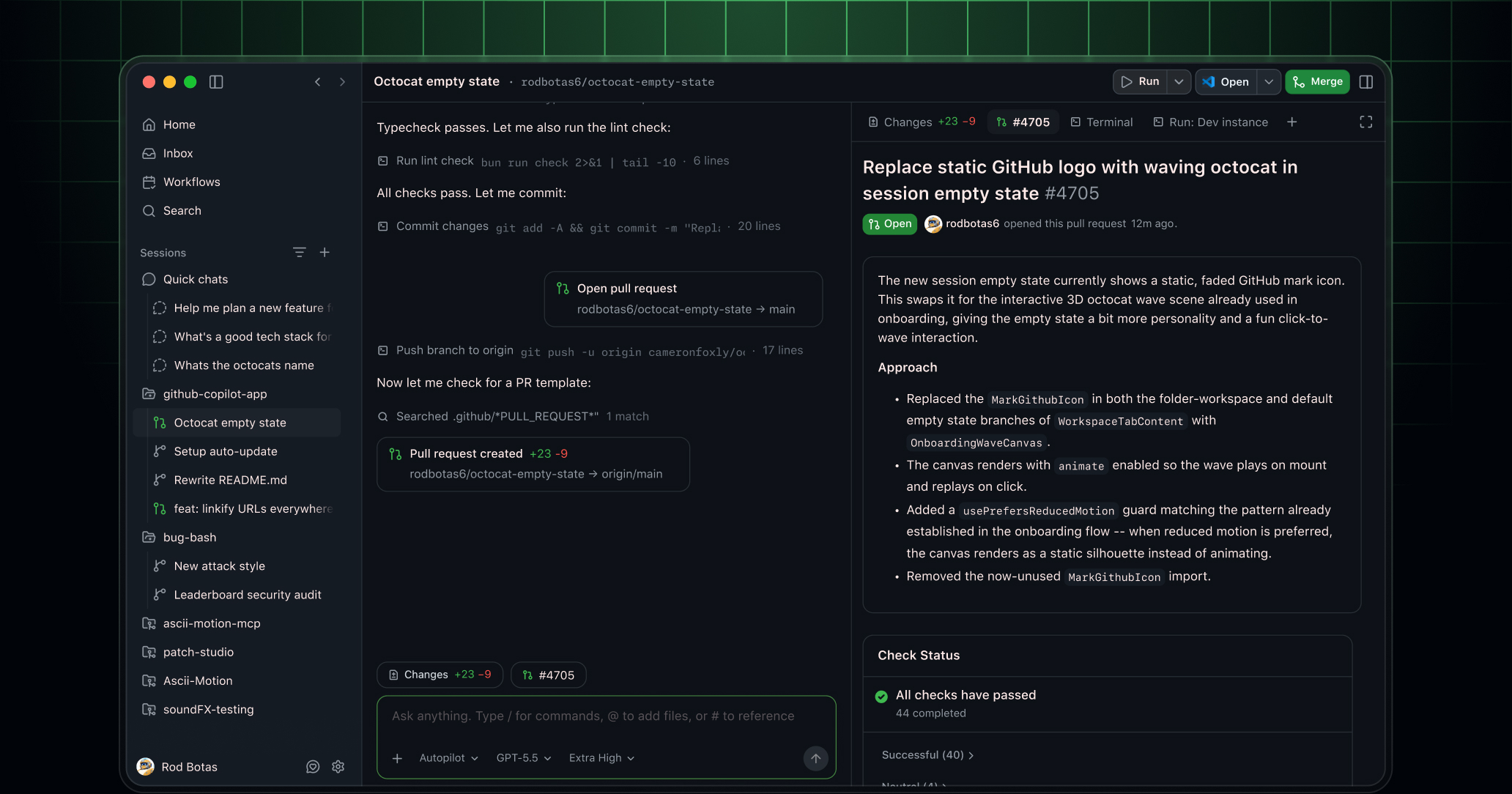

GitHub Copilot app기술 프리뷰를 공개했습니다.- 이슈, PR, 프롬프트, 이전 세션에서 에이전트 개발 세션을 시작하고, 격리된 작업 공간에서 검증과 PR까지 이어가는 데 초점이 있습니다.

- 의미: Copilot은 자동완성 도구에서 여러 코딩 에이전트 세션을 관리하는 작업대로 이동하고 있습니다.

- 같은 주 변화: REST API, JetBrains unified sessions, auto model selection, team metrics가 함께 나왔습니다.

- GitHub은 실행 표면, 자동화 입구, 모델 선택, 조직 측정을 한꺼번에 정렬하고 있습니다.

- 주의점: 기술 프리뷰라 접근 조건, 정책 설정, 사용량 과금 체감은 아직 안정된 제품 경험으로 보기 어렵습니다.

GitHub이 2026년 5월 14일 GitHub Copilot app 기술 프리뷰를 공개했습니다. 이름만 보면 또 하나의 Copilot 클라이언트처럼 보입니다. 하지만 이번 발표의 핵심은 화면이 하나 늘었다는 데 있지 않습니다. GitHub은 코딩 에이전트가 시작하고, 격리된 공간에서 일하고, 사용자가 검토하고, 테스트하고, PR로 보내고, 리뷰 코멘트와 실패한 체크까지 따라가는 흐름을 GitHub 작업 단위 안에 모으려 합니다.

공식 발표는 Copilot app을 "GitHub-native desktop experience"라고 부릅니다. 세션은 이슈, 풀 리퀘스트, 프롬프트, 이전 세션 같은 실제 작업 맥락에서 시작됩니다. 각 세션은 branch, files, conversation, task state를 따로 갖습니다. 사용자는 세션을 잠시 멈췄다가 다시 이어가고, 한 저장소 또는 여러 저장소의 작업을 분리해 진행할 수 있습니다. 마지막에는 plan과 diff를 검토하고, 명령 실행, preview, 브라우저 테스트로 검증한 뒤 PR을 열 수 있습니다.

이 설명에서 중요한 단어는 "chat"이 아니라 "session"입니다. AI 코딩 도구 시장은 오랫동안 IDE 안의 자동완성, 채팅, 에이전트 모드로 설명됐습니다. 그런데 실제 개발 업무에서는 한 번의 답변보다 작업의 생명주기가 더 중요합니다. 어떤 이슈에서 시작했는지, 어느 브랜치에서 움직였는지, 어떤 파일을 바꿨는지, 테스트는 무엇을 돌렸는지, 리뷰 코멘트가 무엇이었는지, 실패한 체크를 누가 다시 고쳤는지가 모두 남아야 합니다. GitHub Copilot app은 이 생명주기를 데스크톱 앱으로 포장한 제품입니다.

자동완성 다음은 작업대입니다

Copilot의 첫 번째 성공은 코드 자동완성이었습니다. 개발자가 쓰는 줄 옆에서 다음 코드를 제안하고, 채팅으로 설명을 붙이고, IDE 안에서 작은 수정을 돕는 방식입니다. 이 모델에서는 사용자가 중심이고 AI는 옆자리 보조자에 가깝습니다. 사용자가 파일을 열고, 맥락을 선택하고, 제안을 받아들이거나 버립니다.

에이전트형 개발은 다릅니다. 사용자는 "이 이슈를 고쳐줘", "이 마이그레이션을 여러 패키지에 적용해줘", "리뷰 코멘트를 반영해줘"처럼 작업 단위를 던집니다. 그러면 에이전트는 계획을 세우고, 저장소를 읽고, 파일을 수정하고, 테스트를 돌리고, 실패를 다시 고칩니다. 이 과정은 몇 초짜리 자동완성이 아니라 수분에서 수십 분짜리 작업 세션입니다. 그래서 UI도 채팅창 하나로 끝나기 어렵습니다.

GitHub이 이번에 강조한 격리도 같은 맥락입니다. 공식 문서는 agent sessions에서 각 세션이 자체 isolated workspace에서 실행되며, 사용자가 여러 세션을 병렬로 돌릴 수 있다고 설명합니다. 새 세션을 만들 때 local folder, GitHub 저장소, URL clone을 고르고, 새 working tree 또는 local repository 실행 여부를 선택하며, session mode, model, reasoning effort를 지정합니다. 이것은 "AI에게 질문하기"보다 "작업자를 배치하기"에 가까운 UX입니다.

물론 GitHub이 처음으로 이런 문제를 발견한 것은 아닙니다. Cursor는 cloud agents와 Teams 통합을 밀고 있고, Claude Code와 Codex도 장시간 작업과 도구 실행을 중심으로 경쟁합니다. 차이는 GitHub의 기준점입니다. GitHub은 저장소, 이슈, PR, Actions, checks, code review, merge policy가 이미 모인 곳입니다. Copilot app은 그 위에 에이전트 작업대를 얹습니다. 코딩 에이전트를 IDE 바깥으로 꺼내지만, 최종 상태는 여전히 GitHub의 협업 객체로 돌아오게 만드는 구조입니다.

같은 주에 나온 조각들이 더 중요합니다

이번 발표를 Copilot app 하나만 보면 제품 클라이언트 뉴스입니다. 그러나 2026년 5월 13일과 14일 GitHub changelog를 나란히 보면 그림이 커집니다. 5월 13일에는 Copilot cloud agent tasks REST API가 공개 프리뷰로 나왔습니다. Business와 Enterprise 사용자는 API로 cloud agent task를 시작하고 진행 상황을 추적할 수 있습니다. GitHub은 예시로 여러 저장소에 refactor나 migration을 fan-out하거나, 사내 developer portal에서 새 저장소 설정을 한 번에 처리하거나, 주간 release notes를 자동 준비하는 흐름을 들었습니다.

같은 날 JetBrains IDE 쪽에는 Copilot CLI agent와 unified sessions view가 들어갔습니다. JetBrains 사용자는 IDE에서 로컬로 실행되는 Copilot CLI agent에 작업을 위임할 수 있고, worktree isolation과 workspace isolation 중 하나를 고릅니다. 세션 화면은 running과 queued session의 live status, tool calls, 변경 요약을 보여줍니다. 즉 IDE 안에서도 "에이전트 세션 목록"이 제품 개념으로 올라왔습니다.

5월 14일에는 cloud agent auto model selection도 추가됐습니다. Auto를 고르면 Copilot이 시스템 상태와 모델 성능을 기준으로 모델을 선택하고, GitHub은 정상 model multiplier 대비 10% 할인을 제공하며 weekly rate limit 영향을 받지 않는다고 설명합니다. 같은 날 team-level Copilot usage metrics API는 user-teams report와 per-user usage report를 조인해 팀별 활성 사용자, completions, chats, Copilot CLI, code review, cloud agent activity를 집계할 수 있게 했습니다.

이 네 가지를 묶으면 GitHub의 방향이 보입니다. Copilot app은 사람이 보는 작업대입니다. REST API는 사내 자동화가 에이전트 작업을 생성하는 입구입니다. JetBrains unified sessions는 IDE 안의 세션 관제 화면입니다. Auto model selection은 실행 비용과 모델 선택을 플랫폼 쪽으로 넘기는 장치입니다. Team metrics API는 조직이 에이전트 사용을 팀 단위로 측정하게 만드는 계측면입니다. 각각은 작은 changelog지만, 합치면 코딩 에이전트를 조직 운영 시스템으로 만드는 조각입니다.

| 발표 | 표면 | 실무 의미 |

|---|---|---|

| Copilot app | 데스크톱 작업대 | 이슈, PR, 세션, 검증, Agent Merge를 한 흐름으로 연결 |

| Agent tasks REST API | 자동화 입구 | 사내 포털, 스크립트, 릴리스 자동화에서 cloud agent task 생성 |

| JetBrains sessions | IDE 세션 관제 | 로컬 CLI agent 작업을 IDE 맥락과 live status로 추적 |

| Team metrics API | 조직 측정 | 팀별 adoption, 모델, 기능, cloud agent 활동을 API로 집계 |

GitHub이 유리한 지점은 리뷰와 체크입니다

코딩 에이전트의 어려움은 코드를 고치는 순간보다 그 이후에 자주 드러납니다. 에이전트가 diff를 만들 수는 있어도, 그 diff가 팀의 리뷰 기준을 통과하는지, CI가 실패했을 때 어떤 로그를 봐야 하는지, 리뷰 코멘트를 어느 우선순위로 반영해야 하는지, 언제 merge할 수 있는지는 별개의 문제입니다. GitHub은 이미 이 후반부를 플랫폼으로 갖고 있습니다.

Copilot app 발표에서 눈에 띄는 문장은 "The work is not finished when code changes"라는 대목입니다. GitHub은 code change가 끝이 아니라 review, test, ready to merge까지 가야 작업이 끝난다고 설명합니다. 그래서 앱 안에서 plan과 diff를 검토하고, integrated terminal과 browser로 검증하고, PR을 열고, Agent Merge로 review comments와 failing checks를 처리하게 합니다.

이것은 GitHub의 가장 강한 논리입니다. Cursor나 Claude Code, Codex가 뛰어난 coding loop를 제공하더라도, 많은 팀의 최종 협업 단위는 여전히 GitHub PR입니다. 리뷰어는 GitHub에서 코멘트를 남기고, Actions는 GitHub에서 실패하고, branch protection과 merge requirements도 GitHub에 있습니다. GitHub이 에이전트 세션을 PR 생명주기와 강하게 묶으면, "코드를 잘 쓰는 도구"가 아니라 "변경을 병합 가능한 상태로 밀어 넣는 도구"로 포지셔닝할 수 있습니다.

다만 이것은 동시에 GitHub 중심 조직에 가장 잘 맞는 전략입니다. GitLab, Bitbucket, Gerrit, 사내 코드 호스팅, 별도 CI, Jira/Linear 중심 프로세스를 쓰는 팀에는 GitHub-native라는 장점이 잠금으로 느껴질 수 있습니다. Copilot app이 얼마나 넓은 외부 시스템과 자연스럽게 붙는지, GitHub 바깥의 작업 맥락을 어떻게 가져오는지는 앞으로 봐야 할 지점입니다.

Skills와 MCP는 앱 설정으로 들어옵니다

GitHub Docs의 customization 문서는 Copilot app이 단순 데스크톱 래퍼가 아니라 에이전트 설정 표면이라는 점을 보여줍니다. 사용자는 global instructions를 설정할 수 있고, agent skills를 추가할 수 있으며, MCP servers를 구성할 수 있습니다. 문서는 repository나 Copilot CLI에 구성된 skills와 MCP servers가 Copilot app에서도 자동으로 사용 가능하다고 설명합니다.

이 부분은 최근 Copilot CLI 플러그인 표준화 흐름과 이어집니다. 지난 글에서 다룬 기업 관리형 CLI 플러그인은 조직이 어떤 skills, hooks, MCP 구성을 배포할지의 문제였습니다. Copilot app은 그 구성이 실제 세션 작업대로 흘러 들어오는 표면입니다. 한마디로 GitHub은 "에이전트가 무슨 지식과 도구를 갖고 일하는가"를 CLI, IDE, desktop app, cloud agent 사이에서 맞추려 합니다.

개발팀 입장에서는 이것이 꽤 현실적인 문제입니다. 에이전트가 사내 프레임워크를 모르면 잘못된 코드를 씁니다. 사내 API 문서를 못 보면 public API를 상상합니다. MCP 서버가 개인별로 다르면 어떤 세션은 내부 티켓을 읽고, 어떤 세션은 못 읽습니다. Skills와 MCP를 앱 설정으로 들여오는 일은 편의 기능이 아니라 결과 재현성과 권한 관리의 문제입니다.

하지만 설정 표면이 늘어날수록 운영 복잡도도 늘어납니다. 어느 설정이 repository instruction인지, 어느 설정이 CLI plugin인지, 어느 설정이 app global instruction인지, 어느 MCP 서버가 조직 정책으로 허용됐는지 분명해야 합니다. AI 코딩 도구가 강해질수록 prompt와 tool 설정은 사실상 개발 환경 설정이 됩니다. .editorconfig나 CI 설정처럼 버전 관리와 리뷰가 필요한 대상이 되는 것입니다.

Scheduled workflows는 "반복 작업자"의 입구입니다

Copilot app의 scheduled workflows 문서는 또 다른 방향을 보여줍니다. 사용자는 반복 에이전트 작업을 저장하고, 일정 또는 수동으로 실행할 수 있습니다. GitHub이 든 예시는 매일 새 이슈를 triage하거나, 매일 아침 open PR의 review status를 확인하는 작업입니다. workflow 생성 시 prompt를 쓰고, /로 skills를 추가하고, interval, session mode, project, model, reasoning effort를 설정합니다.

이 기능은 GitHub Actions와 겹쳐 보일 수 있습니다. 그러나 차이는 실행 주체입니다. Actions는 결정적 스크립트와 CI/CD에 강합니다. Scheduled workflows는 자연어 prompt와 에이전트 세션에 가깝습니다. 매일 "이슈를 분류하고, 누락된 정보가 있으면 질문하고, 적절한 label과 assignee를 제안하라" 같은 흐름은 전통적 YAML 자동화보다 에이전트에 더 잘 맞을 수 있습니다.

물론 이 지점에서 위험도 커집니다. 반복 에이전트가 이슈나 PR에 글을 남기거나, 브랜치를 만들거나, release notes를 준비한다면, 팀은 실행 권한과 실패 모드를 설계해야 합니다. 어떤 workflow가 자동으로 PR을 열 수 있는지, 어떤 workflow는 draft만 남겨야 하는지, 사람이 승인하기 전에는 어떤 외부 시스템을 건드리지 못하게 할지 정해야 합니다. 기술 프리뷰 단계에서 이 기능을 쓰는 팀이라면 "어떤 작업을 반복시킬 것인가"보다 "어디까지 자동으로 하게 둘 것인가"를 먼저 정해야 합니다.

비용과 측정은 이미 제품 안에 들어왔습니다

GitHub Copilot 생태계의 최근 흐름에서 비용 이야기를 빼놓기 어렵습니다. 5월 14일 auto model selection 발표는 Auto 선택 시 정상 model multiplier 대비 10% 할인과 weekly rate limit 예외를 언급합니다. team-level metrics API는 팀 단위로 어떤 기능, 모델, IDE, language, cloud agent 활동이 일어났는지 집계하게 합니다. 이는 기술 기능이면서 동시에 AI 사용량 운영의 기초입니다.

AI 코딩 에이전트가 개인 생산성 도구일 때는 "개발자가 체감상 더 빨라졌는가"가 주요 질문이었습니다. 조직 도구가 되면 질문이 바뀝니다. 어느 팀이 실제로 쓰는가, IDE 자동완성과 cloud agent 사용을 구분할 수 있는가, 어떤 모델이 비용을 많이 쓰는가, agent task가 PR throughput이나 review burden에 어떤 영향을 주는가, 사용량 기반 과금이 도입될 때 어느 팀의 예산이 흔들리는가를 봐야 합니다.

GitHub의 team metrics API는 아직 REST API 전용이고, 5명 미만 팀은 user-teams report에서 제외되며, 여러 팀에 속한 사용자의 활동은 각 팀 집계에 중복 반영될 수 있습니다. 이 제약은 중요합니다. 숫자가 나온다고 바로 ROI가 되는 것은 아닙니다. 팀별 active users와 completions는 adoption 지표일 수 있지만, 좋은 코드 변경이나 리뷰 시간 단축을 직접 증명하지는 않습니다. 그래도 조직이 AI 코딩 에이전트를 관리하려면 이런 기본 계측면은 필요합니다.

커뮤니티 반응도 이 지점에서 민감합니다. r/GithubCopilot의 공개 스레드에서는 Copilot app 자체보다 제품군의 분절과 요금 체감에 대한 이야기가 함께 나왔습니다. 기술 프리뷰를 보는 개발자 입장에서는 새 앱, CLI, cloud agent, IDE agent, usage metrics, model multiplier가 동시에 움직입니다. 기능이 늘수록 "무엇을 쓰면 얼마가 나가고, 어느 한도에 걸리는가"가 더 중요해집니다.

경쟁 구도는 IDE에서 운영면으로 옮겨갑니다

AI 코딩 도구 경쟁은 여전히 모델 품질과 편집 경험이 중요합니다. 빠르게 diff를 만들고, 테스트 실패를 이해하고, 대규모 리팩터링을 덜 망치는 능력은 핵심입니다. 그러나 GitHub의 이번 발표 묶음은 경쟁의 일부가 운영면으로 이동하고 있음을 보여줍니다. 누가 더 좋은 답을 한 번 내느냐만큼, 누가 에이전트 세션을 격리하고, 추적하고, 검증하고, 팀별로 측정하고, 사내 자동화와 연결하는지가 중요해집니다.

Cursor는 에디터와 cloud agents를 중심으로 개발자 경험을 밀어붙입니다. Claude Code는 터미널과 장시간 agent loop에서 강한 인상을 만들었습니다. Codex는 OpenAI 생태계와 desktop/mobile/브라우저 자동화 쪽으로 확장하고 있습니다. GitHub의 차별점은 저장소와 협업의 원장입니다. 이슈, PR, checks, reviews, merge policy를 갖고 있으므로 에이전트가 만든 변경의 끝단을 잡을 수 있습니다.

앞으로의 질문은 명확합니다. Copilot app이 실제로 개발자의 기본 작업대가 될 수 있을까요. 아니면 GitHub의 여러 Copilot 표면 중 하나로 남을까요. 기술 프리뷰가 성공하려면 세션 전환이 빠르고, local/remote 작업 격리가 안정적이며, IDE와 CLI에서 시작한 맥락이 앱에서 자연스럽게 이어져야 합니다. 또한 Agent Merge가 리뷰어의 신뢰를 얻어야 합니다. 실패한 체크를 "어떻게든 고치는" 도구가 아니라, 변경 의도와 품질 기준을 이해하는 후속 작업자로 보여야 합니다.

지금 개발팀이 볼 포인트

지금 당장 모든 팀이 Copilot app을 도입할 필요는 없습니다. 기술 프리뷰이고 접근 조건도 제한적입니다. 그러나 방향은 살펴볼 가치가 있습니다. 첫째, 팀의 코딩 에이전트 사용을 "개별 도구 선택"이 아니라 "작업 세션 관리"로 봐야 합니다. 누가 어떤 에이전트에 어떤 작업을 맡겼고, 어떤 브랜치와 PR이 생겼고, 어떤 검증을 통과했는지 추적할 수 있어야 합니다.

둘째, Skills와 MCP를 개인 설정으로 방치하지 않는 것이 좋습니다. 에이전트가 사내 규칙과 도구를 쓰게 하려면 instruction, skill, MCP, hook의 소유권이 필요합니다. 셋째, 반복 작업 자동화는 작은 것부터 시작해야 합니다. issue triage, release note draft, stale PR 확인처럼 실패해도 되돌리기 쉬운 작업이 먼저입니다. 대규모 migration이나 자동 merge는 정책과 측정이 준비된 뒤에 다루는 편이 맞습니다.

넷째, 사용량 지표를 단순 소비량으로만 보지 말아야 합니다. Copilot CLI, code review, cloud agent activity가 팀별로 보이기 시작하면, 조직은 비용 통제뿐 아니라 enablement gap도 볼 수 있습니다. 어떤 팀은 에이전트를 잘 쓰고, 어떤 팀은 전혀 쓰지 못하고, 어떤 팀은 비싼 모델만 많이 태울 수 있습니다. 이 차이를 읽지 못하면 AI 도입은 "전체 좌석 수"만 늘고 실제 작업 방식은 바뀌지 않습니다.

GitHub Copilot app 기술 프리뷰는 아직 완성된 답이 아닙니다. 하지만 질문은 분명합니다. 코딩 에이전트가 늘어날수록 개발자는 더 많은 채팅창을 원하는 것이 아니라, 여러 작업자를 안전하게 배치하고, 중간 결과를 보고, 검증하고, 리뷰와 PR로 연결하는 작업대를 원합니다. GitHub은 그 작업대가 GitHub 위에 있어야 한다고 말하고 있습니다. 이번 발표의 진짜 의미는 거기에 있습니다.