Claude Code 한도 2배 상향, 병목은 이제 컴퓨트다

Anthropic이 SpaceX Colossus 1 컴퓨트 계약과 함께 Claude Code 5시간 한도를 2배로 올렸습니다. AI 코딩 에이전트의 병목이 모델에서 인프라로 이동하고 있습니다.

- 무슨 일: Anthropic이 SpaceX와 Colossus 1 컴퓨트 계약을 맺고

Claude Code5시간 한도를 2배로 올렸습니다.- Pro, Max, Team, 좌석 기반 Enterprise 플랜에 적용되며, Pro와 Max의 피크 시간대 한도 축소도 제거됐습니다.

- 숫자: Anthropic은 한 달 안에 300MW 초과 용량과 220,000개 초과 NVIDIA GPU에 접근한다고 밝혔습니다.

- 의미: AI 코딩 에이전트 경쟁의 병목이 모델 품질만이 아니라 컴퓨트 공급, 한도 정책, 장시간 세션 안정성으로 이동하고 있습니다.

- 주의점: orbital AI compute는 아직 확정 배포가 아니라 양측이 관심을 표명한 장기 인프라 서사로 읽어야 합니다.

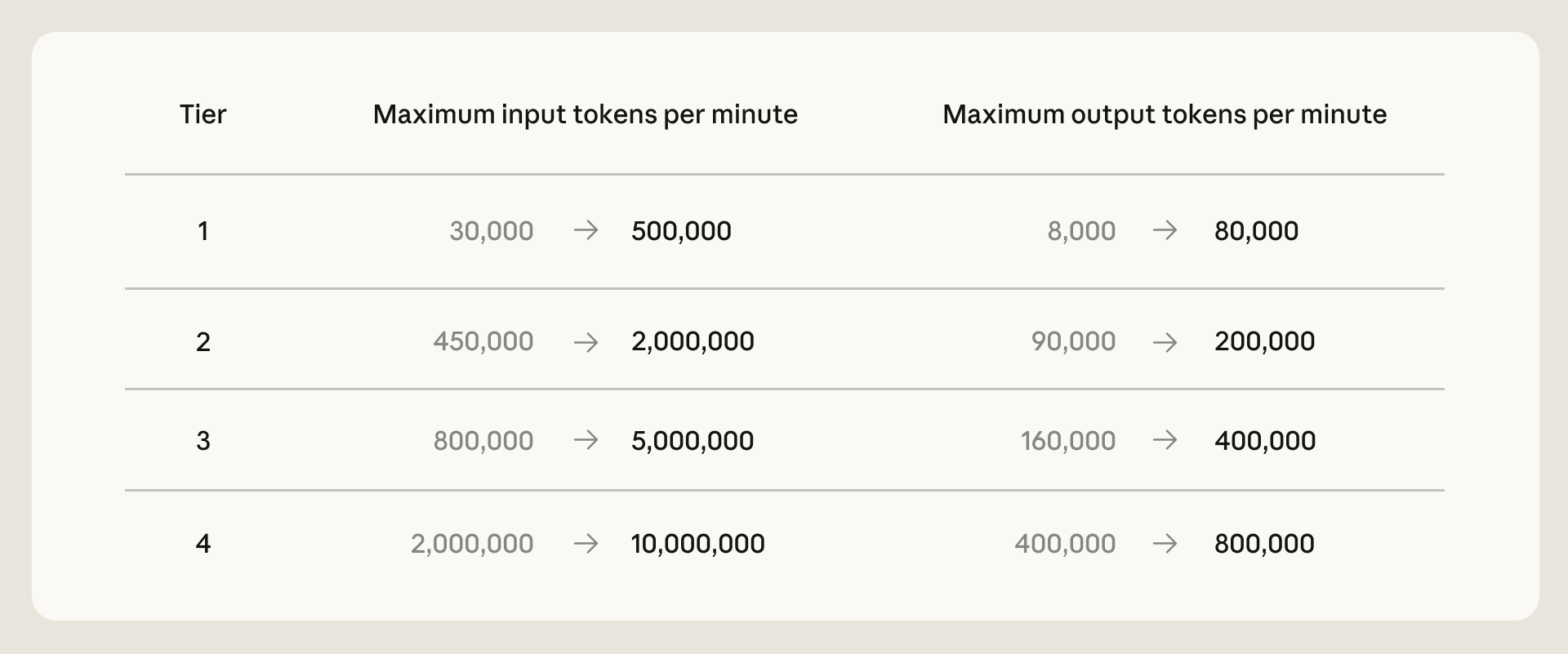

Anthropic이 2026년 5월 6일 SpaceX와의 컴퓨트 파트너십을 발표했습니다. headline은 SpaceX라는 이름과 220,000개가 넘는 NVIDIA GPU로 보이지만, 개발자에게 바로 닿는 변화는 더 구체적입니다. Claude Code의 5시간 사용량 제한이 Pro, Max, Team, 좌석 기반 Enterprise 플랜에서 2배로 늘었고, Pro와 Max 계정에 적용되던 피크 시간대 한도 축소가 제거됐습니다. Claude Opus 모델의 API rate limit도 크게 올라갔습니다.

이 발표는 단순한 용량 증설 뉴스가 아닙니다. AI 코딩 에이전트 시장의 병목이 어디로 이동하고 있는지 보여줍니다. 2024년과 2025년의 경쟁은 "어떤 모델이 코드를 더 잘 쓰는가", "툴콜을 얼마나 잘 하는가", "IDE 안에서 얼마나 자연스럽게 작동하는가"에 가까웠습니다. 2026년의 경쟁은 여기에 하나가 더 붙었습니다. 에이전트가 충분히 오래, 충분히 많이, 충분히 안정적으로 돌아갈 수 있는가입니다.

Claude Code를 길게 써본 개발자라면 이 차이를 바로 이해합니다. 짧은 함수 수정이나 단일 파일 리팩터링에서는 모델 품질이 가장 중요합니다. 하지만 실제 업무는 점점 다릅니다. 큰 코드베이스를 읽고, 여러 파일을 고치고, 테스트를 돌리고, 실패 로그를 다시 읽고, 다른 접근을 시도하고, 마지막에는 PR 설명까지 정리합니다. 이 루프는 토큰과 시간과 도구 호출을 계속 소모합니다. 병렬 세션이나 서브에이전트를 붙이면 소비 속도는 더 빨라집니다.

그래서 이번 뉴스의 핵심은 "Anthropic이 SpaceX 컴퓨트를 샀다"보다 "Claude Code의 사용 가능한 작업 시간이 늘었다"에 가깝습니다. AI 코딩 도구가 장난감에서 일상 도구로 넘어갈 때, 사용량 제한은 UX의 일부가 됩니다. 모델이 충분히 똑똑해도 한도에 자주 걸리면 개발자는 작업을 나누고, 시간을 맞추고, 다른 도구로 우회해야 합니다. 반대로 한도가 늘면 에이전트에게 맡길 수 있는 작업의 단위가 커집니다.

무엇이 바뀌었나

Anthropic 공식 발표는 변경 사항을 세 가지로 정리합니다. 첫째, Claude Code의 5시간 rate limit이 Pro, Max, Team, 좌석 기반 Enterprise 플랜에서 2배로 늘었습니다. 둘째, Pro와 Max 계정에 적용되던 Claude Code 피크 시간대 한도 축소가 제거됐습니다. 셋째, Claude Opus 모델의 API rate limit이 크게 상향됐습니다.

이 세 가지는 모두 발표 당일부터 적용됩니다. 특히 피크 시간대 제한 제거는 단순한 숫자 이상의 의미가 있습니다. 개발자는 대부분 업무 시간에 도구를 씁니다. 미국 업무 시간 피크에 제한이 줄어드는 구조라면, 가장 필요할 때 가장 빨리 벽에 부딪힙니다. 한도가 평시에는 충분해 보여도, 팀이 동시에 일하는 시간대에 줄어들면 체감 품질은 나빠집니다.

Claude Code의 5시간 창도 중요합니다. Anthropic의 구독형 Claude 사용량은 하루 고정량보다 rolling window 성격이 강합니다. 사용자는 긴 디버깅 세션을 돌리다가 "지금은 멈춰야 하는" 상태를 만나고, 몇 시간 뒤 다시 이어갑니다. 사람의 개발 리듬과 에이전트의 사용량 창이 어긋나면, 도구가 일을 줄여주는 것이 아니라 작업 계획의 또 다른 변수가 됩니다.

API rate limit 상향은 Claude Code 사용자만의 문제가 아닙니다. 많은 팀은 Claude를 내부 agent framework, 코드 리뷰 봇, 문서 생성 파이프라인, 고객지원 자동화, 데이터 분석 작업에 API로 붙이고 있습니다. Opus 계열은 비싸지만 깊은 추론이나 복잡한 판단에 쓰입니다. API throughput이 올라가면 더 많은 작업을 동시에 보내거나, peak traffic에서 대기 시간을 줄이거나, batch workflow를 더 공격적으로 설계할 수 있습니다.

물론 rate limit이 오른다고 모든 문제가 사라지는 것은 아닙니다. 모델 응답 품질, 도구 호출 안정성, 컨텍스트 관리, 비용 통제는 여전히 남습니다. 하지만 한도는 실무 도입에서 생각보다 근본적인 제약입니다. 에이전트는 한 번 호출하고 끝나는 API가 아니라 반복적으로 생각하고 행동하는 시스템입니다. 반복 횟수와 동시성의 천장이 낮으면, 제품 설계 자체가 보수적으로 바뀝니다.

SpaceX Colossus 1이 붙었다

이번 변화의 배경은 SpaceX와의 컴퓨트 계약입니다. Anthropic은 SpaceX의 Colossus 1 데이터센터 전체 컴퓨트 용량을 사용하기로 했고, 이를 통해 한 달 안에 300MW를 넘는 신규 용량과 220,000개가 넘는 NVIDIA GPU에 접근한다고 밝혔습니다. xAI 공식 발표는 Colossus 1이 H100, H200, GB200 가속기를 포함한다고 설명합니다.

숫자만 보면 압도적입니다. 하지만 더 흥미로운 것은 이 용량이 곧바로 제품 한도 정책으로 연결됐다는 점입니다. AI 인프라 발표는 종종 장기 계획에 머뭅니다. 몇 년 뒤 데이터센터가 완공되고, 전력 계약이 체결되고, 칩이 들어오고, 이후 모델 훈련에 쓰인다는 식입니다. 이번 발표는 다릅니다. Anthropic은 컴퓨트 파트너십을 말하면서 바로 Claude Code와 Claude API의 사용 한도를 올렸습니다.

이 차이는 AI 제품 경쟁에서 중요합니다. 모델 회사가 컴퓨트를 확보했다는 말은 이제 "더 큰 모델을 언젠가 훈련할 수 있다"만 뜻하지 않습니다. 현재 사용자의 세션 길이, 동시성, 대기열, peak-hour throttling, API rate limit에 영향을 줍니다. 개발자 입장에서는 논문 점수보다 더 현실적인 차이입니다. 오늘 작업이 끊기지 않는가, 팀원이 동시에 에이전트를 돌릴 수 있는가, 중요한 배치 작업이 제한 없이 끝나는가가 구매 판단에 들어갑니다.

Anthropic은 이번 계약을 Amazon, Google/Broadcom, Microsoft/NVIDIA, Fluidstack과의 기존 컴퓨트 확장 발표 위에 더했습니다. Amazon과는 최대 5GW 계약을 말했고, Google/Broadcom과도 5GW 규모를 언급했으며, Microsoft/NVIDIA와는 300억 달러 규모 Azure capacity, Fluidstack과는 미국 AI 인프라 500억 달러 투자를 발표한 바 있습니다. 이번 SpaceX 계약은 그 긴 목록 중 하나이지만, 사용량 한도와 직접 연결된 점 때문에 더 선명합니다.

AI 코딩 에이전트의 병목이 바뀐다

AI 코딩 도구를 평가할 때 흔히 benchmark를 봅니다. SWE-bench, Terminal-Bench, 내부 eval, 코드 리뷰 정확도, 버그 수정률 같은 숫자입니다. 이런 지표는 필요합니다. 하지만 실제 개발팀이 매일 쓰는 도구에서는 다른 지표도 중요합니다. 한도에 얼마나 자주 걸리는가. 긴 세션에서 컨텍스트와 작업 계획을 유지하는가. 여러 작업을 동시에 맡길 수 있는가. 장애나 peak 시간대에 예측 가능하게 동작하는가.

Claude Code, OpenAI Codex, Cursor, GitHub Copilot, Gemini CLI 같은 도구가 모두 에이전트 모드로 이동하면서 사용 패턴도 달라졌습니다. 예전 자동완성 도구는 작은 요청을 자주 보냈습니다. 에이전트형 코딩 도구는 하나의 큰 목표를 잡고 반복 실행합니다. "이 테스트 실패를 고쳐줘"가 아니라 "이 모듈의 인증 흐름을 정리하고, 관련 테스트를 갱신하고, 문서도 맞춰줘" 같은 작업입니다.

이런 작업은 고정된 한 번의 답변보다 워크플로에 가깝습니다. 에이전트는 탐색하고, 파일을 읽고, 계획하고, 수정하고, 검증하고, 실패하면 다시 수정합니다. 중간에 사람이 방향을 바꿀 수도 있습니다. 이 모든 과정은 모델 품질과 함께 인프라 품질을 요구합니다. 충분한 컴퓨트가 없으면 모델이 좋아도 제품은 보수적인 한도를 둘 수밖에 없습니다.

그래서 이번 발표는 Anthropic이 Claude Code를 단순한 데모용 개발 도구가 아니라 장시간 작업용 제품으로 밀고 있다는 신호입니다. 사용량 한도 상향은 마케팅 문구보다 더 구체적인 제품 결정입니다. 사용자가 한 번에 맡길 수 있는 작업 단위를 키우고, 팀이 업무 시간에 동시에 쓰는 상황을 더 잘 감당하겠다는 뜻입니다.

피크 시간대 제한 제거가 중요한 이유

피크 시간대 제한은 인프라 사업자의 입장에서는 합리적입니다. 수요가 몰릴 때 전체 서비스 안정성을 지키려면 일부 사용량을 조절해야 합니다. 하지만 사용자 경험에서는 다르게 느껴집니다. 특히 개발 도구는 "한가한 시간에 천천히 쓰는 서비스"가 아닙니다. 장애를 고치거나, 릴리즈 전에 테스트를 통과시키거나, 고객 이슈를 분석할 때 필요합니다.

AI 코딩 에이전트는 업무 도구가 될수록 예측 가능성이 중요해집니다. 오늘 오전에는 긴 작업이 가능했는데 내일 오전에는 피크 제한 때문에 갑자기 멈춘다면, 팀은 그 도구에 핵심 경로를 맡기기 어렵습니다. 개발자는 어느 정도의 한도가 있는지 알고 그 안에서 계획할 수 있습니다. 하지만 시간대별로 체감 한도가 크게 변하면 자동화의 신뢰가 떨어집니다.

Anthropic이 Pro와 Max 계정의 피크 시간대 한도 축소를 제거한 것은 이 문제를 겨냥합니다. 개인 개발자에게는 긴 작업을 끊기지 않고 이어갈 수 있다는 의미가 있고, 팀에는 업무 시간대 사용성을 안정화한다는 의미가 있습니다. Team과 Enterprise 사용자는 5시간 한도 자체가 2배가 됐다는 점이 더 직접적입니다. 좌석 기반 Enterprise까지 포함한 것은 Claude Code를 조직 도구로 밀겠다는 메시지로 볼 수 있습니다.

API rate limit 상향은 에이전트 플랫폼에 더 크다

Claude Code 사용량 증가는 눈에 잘 보이는 변화입니다. 하지만 개발자 플랫폼 관점에서는 Opus API rate limit 상향도 중요합니다. 많은 AI 제품팀은 Claude를 직접 노출하지 않습니다. 내부적으로 prompt router를 만들고, 특정 작업에는 Sonnet이나 Haiku를 쓰고, 어려운 판단에는 Opus를 호출합니다. 이때 rate limit은 architecture를 제한합니다.

예를 들어 코드 리뷰 서비스가 여러 PR을 동시에 분석한다고 해봅시다. PR 하나는 수십 개 파일을 읽고, 테스트 실패 로그를 분석하고, 보안 위험과 타입 오류를 나누어 판단해야 합니다. Opus를 critical reasoning 단계에만 쓰더라도 동시 요청 수가 제한되면 큐가 쌓입니다. 사용자에게는 "AI 리뷰가 늦다"로 보입니다. 내부 배치 작업도 마찬가지입니다. 밤새 문서를 분석하거나, 저장소 migration 후보를 찾거나, 고객 로그를 요약하는 작업은 rate limit에 민감합니다.

이런 팀에게 이번 발표는 "Claude를 더 많이 쓸 수 있다"보다 "Claude를 더 안정적인 생산 시스템 구성 요소로 넣을 수 있다"에 가깝습니다. AI API는 모델 점수만으로 선택되지 않습니다. rate limit, latency, 오류율, region, data policy, 가격, support가 함께 들어갑니다. Anthropic이 컴퓨트 계약을 rate limit 상향으로 번역한 것은 이 시장을 알고 있다는 뜻입니다.

orbital AI compute는 어디까지 믿어야 하나

이번 발표에서 가장 눈길을 끄는 문장은 orbital AI compute입니다. Anthropic은 SpaceX와 복수 GW 규모의 orbital AI compute capacity를 개발하는 데 관심을 표명했다고 썼고, xAI 공식 공지도 SpaceX의 launch cadence, mass-to-orbit economics, constellation operations 경험을 언급했습니다. 표현만 보면 데이터센터가 우주로 올라가는 미래가 바로 다가온 것처럼 느껴집니다.

하지만 이 부분은 차분하게 읽어야 합니다. "expressed interest"는 확정된 deployment 계획이 아닙니다. 전력, 냉각, 발사 비용, 유지보수, 지연 시간, 네트워크, 궤도 혼잡, 규제, 고장 대응까지 풀어야 할 문제가 많습니다. 지상 데이터센터도 전력과 냉각 때문에 어렵지만, 우주 데이터센터는 그 어려움의 종류가 달라집니다.

그럼에도 이 문장이 중요한 이유는 AI 인프라 경쟁의 상상력이 어디까지 커졌는지 보여주기 때문입니다. 몇 년 전에는 GPU 수급이 병목이었습니다. 지금은 전력, 토지, 냉각, 송전망, 지역 규제, 데이터 레지던시, 국가 안보가 함께 얽힙니다. Anthropic이 국제 확장과 regulated industries의 in-region infrastructure를 언급한 것도 같은 맥락입니다. 모델 회사는 더 이상 모델만 만드는 회사가 아닙니다. 전력과 데이터센터와 지정학까지 다루는 인프라 회사가 되고 있습니다.

개발팀은 어떻게 읽어야 하나

개발팀이 이번 뉴스를 읽을 때 가장 먼저 볼 것은 "우리 팀의 AI 에이전트 사용 패턴이 어떤 병목에 걸리는가"입니다. 모델이 실수를 많이 한다면 한도 상향보다 평가와 guardrail이 먼저입니다. 비용이 너무 크다면 더 작은 모델, 캐시, 작업 분해가 중요합니다. 하지만 에이전트가 충분히 유용한데 사용량 제한 때문에 큰 작업을 못 맡기고 있다면, 이번 변화는 실제 생산성에 영향을 줄 수 있습니다.

Claude Code를 쓰는 팀이라면 작업 단위를 다시 생각해볼 수 있습니다. 예전에는 한도 때문에 짧게 끊어 맡겼던 리팩터링, 테스트 보강, migration 검토를 더 긴 세션으로 묶을 수 있습니다. 단, 한도가 늘었다고 검증을 줄여서는 안 됩니다. 에이전트가 더 오래 달릴수록 변경 범위도 커집니다. 계획 단계, git diff 검토, 테스트 실행, 사람이 승인하는 경계는 더 중요해집니다.

API를 쓰는 팀이라면 rate limit 상향을 곧바로 비용 증가로 받아들이기보다 throughput 설계의 여지로 봐야 합니다. queue를 줄일 것인지, batch를 키울 것인지, high-reasoning 단계에 Opus를 더 자주 쓸 것인지, 실패 재시도를 더 안정적으로 할 것인지 결정해야 합니다. 한도가 늘면 아키텍처 선택지가 늘지만, 비용 통제와 관측 가능성도 함께 필요합니다.

AI 제품팀에는 더 큰 메시지가 있습니다. AI 기능의 UX는 모델 답변 품질만으로 결정되지 않습니다. 사용량 정책, 대기 시간, 피크 시간 안정성, 지역 인프라, data residency, 고객 support가 모두 UX입니다. 특히 에이전트 제품은 작업이 길고 상태가 많기 때문에, 중간에 멈추는 경험이 더 치명적입니다. 사용자는 "좋은 답변"보다 "일을 끝내는 경험"을 기억합니다.

커뮤니티 반응은 기대와 유보가 섞였다

GeekNews에는 이 발표가 "Anthropic, SpaceX와의 컴퓨트 계약으로 Claude 사용 한도를 2배로 확대"라는 제목으로 올라왔습니다. 요약은 공식 발표의 핵심을 잘 압축했습니다. Claude Code 5시간 제한 2배, Pro/Max 피크 시간대 제한 제거, Opus API rate limit 상향, Colossus 1의 300MW 초과 용량과 220,000개 초과 GPU 접근이 주요 항목이었습니다. 다만 댓글은 많지 않아 국내 개발자 커뮤니티의 반응을 크게 일반화하기는 어렵습니다.

Reddit의 Claude Code와 AI 에이전트 관련 스레드에서는 좀 더 체감 중심의 반응이 보였습니다. 긴 코딩 세션에서 한도에 걸리는 것이 실제 병목이었다는 기대가 있었고, Opus API 한도 상향이 병렬 에이전트나 복잡한 reasoning workflow에 도움이 될 것이라는 의견도 있었습니다. 반면 "상향된 한도가 계속 유지될지", "실제 peak 시간대에 안정적으로 체감될지"를 봐야 한다는 유보도 있었습니다.

이 유보는 합리적입니다. AI 서비스의 한도 정책은 수요와 공급에 따라 다시 바뀔 수 있습니다. 특히 에이전트 도구는 사용자가 많아질수록 평균 사용량이 빠르게 올라갑니다. 한도가 늘면 사용자는 더 큰 작업을 맡기고, 더 큰 작업은 더 많은 토큰과 도구 호출을 씁니다. 따라서 이번 상향이 장기적으로 어떤 사용 패턴을 만들지는 아직 관찰이 필요합니다.

OpenAI와 Google에도 같은 문제가 온다

Anthropic만의 이야기는 아닙니다. OpenAI Codex, Google의 AI 코딩 도구, Cursor, GitHub Copilot 모두 비슷한 압박을 받습니다. 에이전트가 좋아질수록 사용자는 더 오래 맡깁니다. 더 오래 맡길수록 컴퓨트 비용과 한도 정책이 제품 경쟁력이 됩니다. 모델 회사와 IDE 회사의 차이는 여기서 드러납니다. IDE 회사는 여러 모델을 라우팅할 수 있지만, 모델 회사는 자체 인프라와 제품 한도를 직접 맞춰야 합니다.

OpenAI는 Microsoft, Oracle, Stargate 계열 인프라 서사와 Codex 제품을 연결하고 있습니다. Google은 TPU와 자체 데이터센터, Gemini 생태계를 갖고 있습니다. Meta는 자체 AI 인프라를 키우고, xAI와 SpaceXAI는 Colossus 같은 초대형 클러스터를 전면에 내세웁니다. 2026년의 AI 경쟁은 모델 카드와 benchmark만으로 설명되지 않습니다. 누가 더 빨리, 더 싸게, 더 안정적으로 inference와 agent runtime을 공급하느냐가 핵심 변수입니다.

특히 AI 코딩은 이 경쟁의 앞단에 있습니다. 코딩 에이전트는 token-heavy하고, tool-heavy하며, 실패하면 재시도합니다. 좋은 사용자는 오히려 많은 컴퓨트를 씁니다. 생산성이 높아질수록 더 많은 작업을 맡기기 때문입니다. 따라서 AI 코딩 제품은 모델 회사의 unit economics를 가장 날카롭게 시험하는 시장입니다.

결론: 에이전트의 성능은 데이터센터에서 완성된다

Anthropic의 SpaceX 컴퓨트 계약은 화려한 인프라 뉴스로 읽힐 수 있습니다. 하지만 개발자에게 더 중요한 것은 Claude Code 한도 2배 상향과 피크 시간대 제한 제거입니다. AI 코딩 에이전트가 실제 업무 도구가 되려면 모델이 똑똑해야 하고, 도구 호출이 안정적이어야 하며, 긴 작업을 버틸 만큼 인프라가 따라와야 합니다.

이번 발표는 그 세 번째 조건을 전면에 올렸습니다. 에이전트의 성능은 모델 파일 안에서만 결정되지 않습니다. 데이터센터, 전력, GPU, rate limit, 구독 정책, API throughput, 지역 인프라가 함께 성능을 만듭니다. 개발자가 체감하는 "똑똑함"의 일부는 사실 "끊기지 않음"입니다.

물론 아직 확인할 것은 남았습니다. 상향된 한도가 실제 peak 시간대에도 일관되게 유지되는지, Opus API rate limit 상향이 비용과 latency에 어떤 영향을 주는지, Anthropic이 장기적으로 구독형 Claude Code의 unit economics를 어떻게 맞출지가 중요합니다. orbital AI compute 같은 장기 서사는 흥미롭지만, 지금 당장 개발자의 작업을 바꾸는 것은 5시간 한도와 피크 제한입니다.

그래도 방향은 분명합니다. AI 코딩 에이전트의 다음 경쟁은 더 멋진 데모만이 아닙니다. 더 긴 작업을 맡기고, 더 많은 세션을 병렬로 돌리고, 업무 시간대에도 예측 가능하게 끝내는 능력입니다. Anthropic은 이번 발표로 그 경쟁의 무대를 모델에서 컴퓨트 인프라까지 넓혔습니다. Claude Code의 한도 2배 상향은 그 변화가 사용자 화면에 도착한 첫 신호입니다.